سفر کلود به سوی حماقت در نمودارها: هزینه صرفهجویی، یا چگونه هزینه API صد برابر شد

چند روز پیش، استلا لورنزو، رئیس بخش هوش مصنوعی در AMD، مطلبی با عنوان «کد کلود برای وظایف مهندسی پیچیده غیرقابل استفاده است» در مخزن رسمی کلود کد منتشر کرد. این شکایت احساسی کاربر نبود، بلکه یک تحلیل کمی بر اساس ۶۸۰۰ جلسه بود. این موضوع، ناخوشایندترین مسئلهی جامعهی هوش مصنوعی را به رخ کشید، و یک سری اعداد و ارقام به طور ویژهای برجسته شدند: یک تغییر پیکربندی برای صرفهجویی در هزینه توسط شرکت آنتروپیک، هزینهی ماهانهی API این تیم را از ۳۴۵ دلار به ۴۲۱۲۱ دلار افزایش داد.

تیم لورنزو ۲۳۵۰۰۰ فراخوانی ابزار، ۱۸۰۰۰ درخواست را ردیابی و تخریب عملکرد سیستمی کلود کد را از فوریه ۲۰۲۶ مستند کرد. این گزارش بعداً توسط The Register پوشش داده شد و طوفانی دو هفتهای از افکار عمومی را در جامعه توسعهدهندگان برانگیخت.

بوریس چرنی، رئیس تیم Anthropic Claude Code، در Hacker News توضیحی ارائه داد. در ۹ فوریه، با انتشار Opus 4.6، یک مکانیزم «خوداندیش» به طور پیشفرض فعال شد، که در آن مدل به طور مستقل مدت زمان تفکر را تعیین میکند. در سوم مارس، آنتروپیک سپس تلاش پیشفرض تفکر را به ۸۵ کاهش داد. توضیح رسمی این بود: «نقطه تعادل بهینه بین هوش، تأخیر و هزینه». تأثیر واقعی این دو تعدیل از دادهها مشهود است.

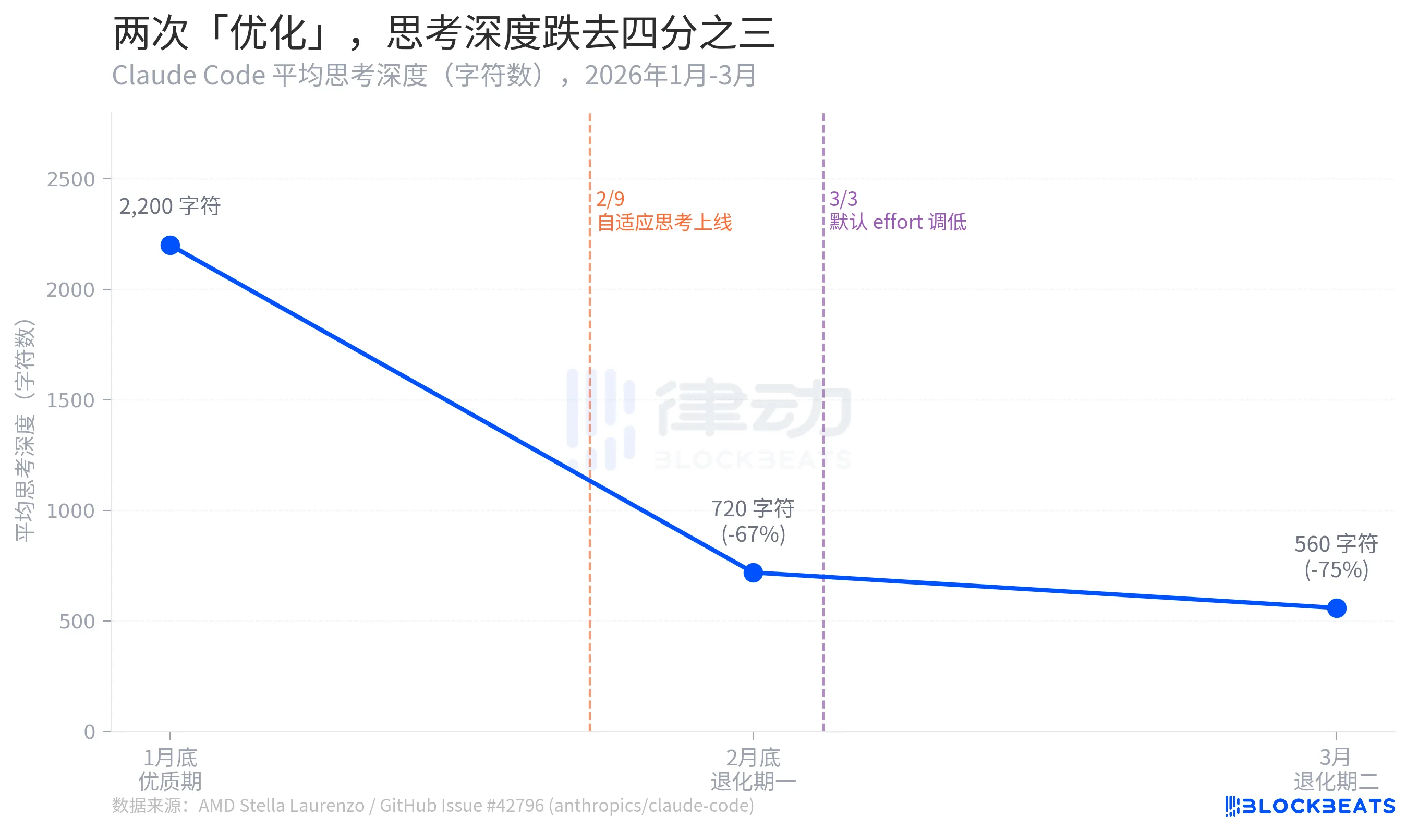

عمق تفکر به میزان سه چهارم کاهش مییابد

طبق دادههای استلا لورنزو در گیتهاب، میانگین عمق تفکر کلود کد طی دو ماه، سقوط سه مرحلهای را تجربه کرد: از اوج ۲۲۰۰ کاراکتر در پایان ژانویه به ۷۲۰ کاراکتر در پایان فوریه، که نشاندهندهی کاهشی ۶۷ درصدی است. تا ماه مارس، این تعداد به ۵۶۰ کاراکتر کاهش یافت که ۷۵ درصد کمتر از اوج خود بود.

عمق تفکر در اینجا یک معیار جایگزین است که نشان میدهد مدل قبل از ارائه پاسخ، چقدر حاضر است «بررسی درونی» انجام دهد. تفاوت بین ۲۲۰۰ و ۵۶۰ کاراکتر تقریباً معادل تنزل رتبه از «پیشنویس قبل از پاسخ دادن» به «فکر کردن به مدت دو ثانیه در ذهن قبل از صحبت کردن» است.

لورنزو همچنین اشاره کرد که ویژگی «ویرایش محتوای فکری» (redact-thinking-2026-02-12) که در اوایل ماه مارس راهاندازی شد، بهطور تصادفی فرآیند فکری مدل را در این دوره پنهان کرد و باعث شد که این کاهش برای کاربران کمتر محسوس باشد. بوریس چرنی اصرار دارد که این صرفاً یک تغییر رابط کاربری بوده و بر استدلال اصلی تأثیری did-133">نداشته است. هر دو ادعا از نظر فنی معتبر هستند، اما از دیدگاه کاربر، تأثیر آنها قابل تشخیص نیست.

بوریس چرنی بعداً اذعان کرد که حتی با تنظیم دستی تلاش به حداکثر، مکانیسم خوداندیشی ممکن است در برخی دورها استدلال ناکافی اختصاص دهد و منجر به محتوای توهمزا شود. «بازگرداندن حداکثر تلاش» یک راه حل کامل نیست؛ این کار صرفاً دستگیره را به موقعیت اولیهاش نزدیکتر میکند، نه اینکه آن را به جبر اولیهاش بازگرداند.

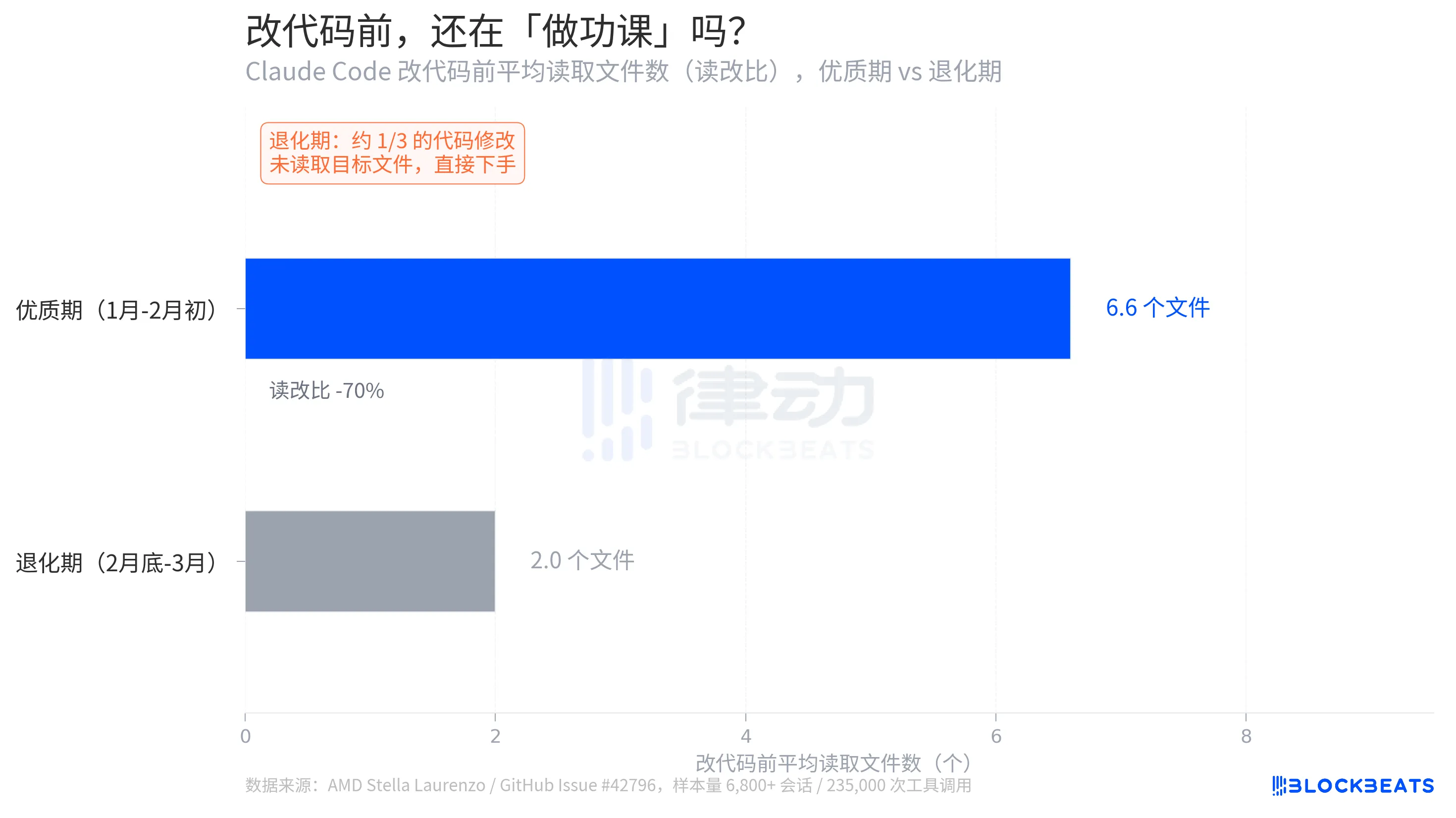

از «برنامهنویس پژوهشمحور» تا «برنامهنویس ویرایش کورکورانه»

یکی از جزئیات گزارش استلا لورنزو صریحتر از تفکر عمیق است: مدل قبل از اعمال تغییرات در کد، چند فایل مرتبط را بهطور فعال میخواند.

طبق دادههای GitHub Issue، در طول دوره اوج، میانگین نسبت خواندن به ویرایش ۶.۶ است. قبل از ایجاد تغییر در کد، مدل به طور متوسط ۶.۶ فایل را میخواند تا زمینه را درک کند. در طول دوره زوال، این عدد به ۲.۰ کاهش مییابد، یعنی ۷۰٪ کاهش. از همه مهمتر، حدود یک سوم ویرایشهای کد بدون خواندن فایل هدف توسط مدل و شروع مستقیم آن انجام میشود.

لورنزو از این به عنوان «ویرایشهای کورکورانه» یاد میکند. از نظر مهندسی، این شبیه به این است که یک برنامهنویس بدون نگاه کردن به امضای توابع یا دانستن نوع متغیرها، کد بنویسد. او در گزارش خود نوشت: «تمام مهندسان ارشد تیم من تجربیات دست اول مشابهی داشتهاند.» دیگر نمیتوان به کلود برای انجام وظایف پیچیده مهندسی اعتماد کرد.

کاهش نسبت خواندن به ویرایش از ۶.۶ به ۲.۰ صرفاً یک تغییر معیار رفتاری نیست؛ بلکه نشاندهندهی سقوط نرخ موفقیت در انجام وظایف است. پیچیدگی مخازن کد مدرن ایجاب میکند که هرگونه تغییری شامل وابستگیهایی در چندین فایل باشد. نادیده گرفتن کاوش زمینه و ایجاد تغییرات مستقیم، صرفاً به «پاسخهای نادرست» منجر نمیشود، بلکه به «تغییرات ظاهراً صحیحی» منجر میشود که خطاهای جدیدی را در ادامهی مسیر ایجاد میکنند. هزینه اشکالزدایی چنین خطاهایی بسیار بیشتر از یک پاسخ صریح ناموفق است.

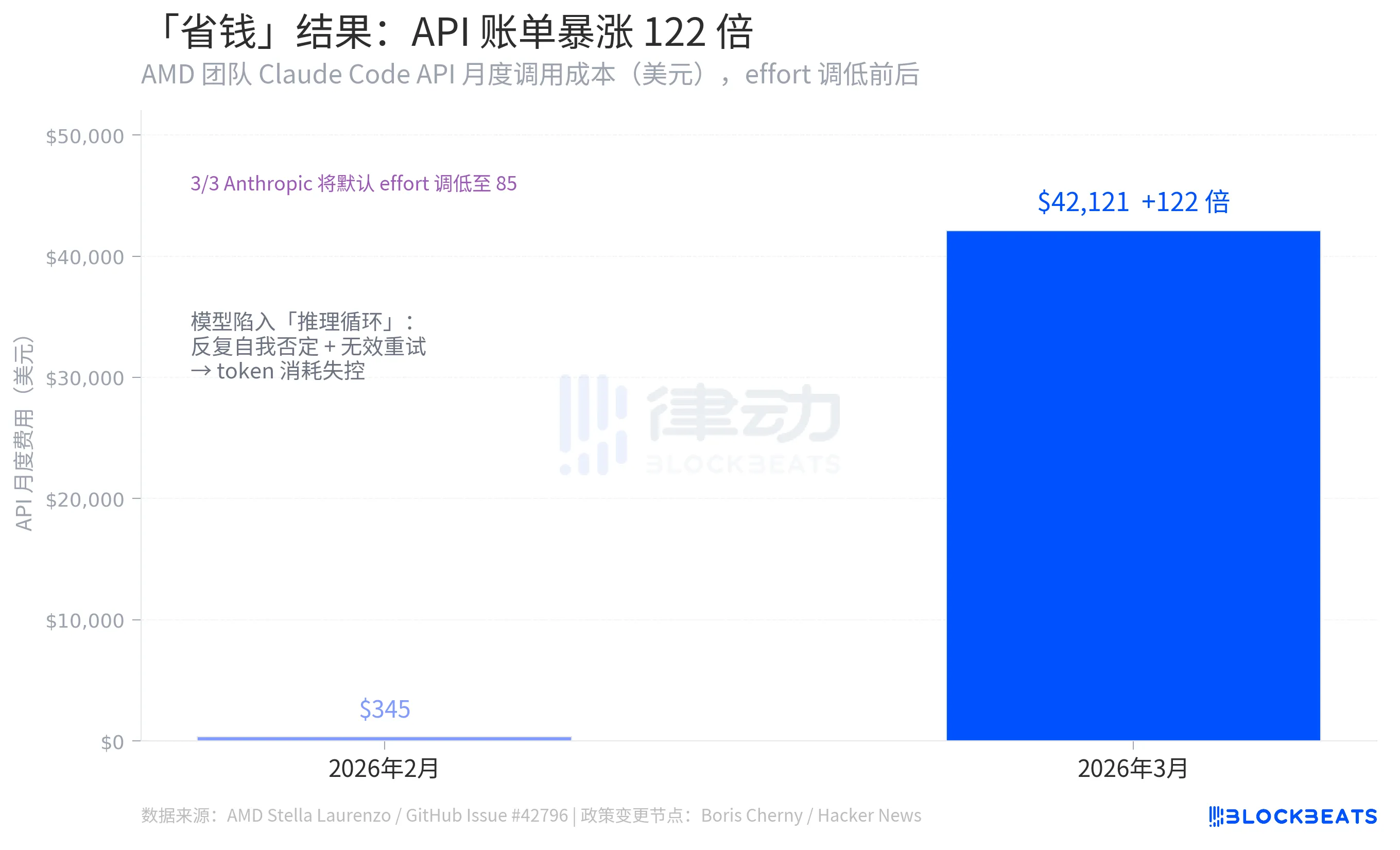

پارادوکس «پسانداز کردن پول»

یکی از عجیبترین مجموعه اعداد و ارقام در کل این حادثه، از همان دادههای مربوط به مشکل گیتهاب میآید: تیم استلا لورنزو شاهد کاهش شدید هزینههای ماهانهی فراخوانی API کلود کد از ۳۴۵ دلار در فوریه ۲۰۲۶ به رقم هنگفت ۴۲۱۲۱ دلار در ماه مارس بود که افزایشی ۱۲۲ برابری را نشان میدهد.

منطق پشت کاهش تلاشهای آنتروپیکس، کاهش مصرف توکن در هر تماس و در نتیجه کاهش هزینهها بود. با این حال، نتیجه برعکس شد. دلیل این امر، ظهور «حلقههای استدلال» متعدد پس از واپاشی مدل بود که منجر به خود-نفی مکرر در یک پاسخ واحد، راهاندازیهای مداوم و مصرف توکن بسیار بیشتر از مقدار صرفهجوییشده میشد. طبق دادههای استلا لورنزو، میزان کاربرانی که داوطلبانه وظایف را متوقف میکنند در همین دوره ۱۲ برابر افزایش یافته است که مستلزم مداخله، اصلاح و ارسال مجدد مداوم توسعهدهندگان است.

منطق اساسی یک خطای سیستمی است. کاهش قدرت محاسباتی در یک کار پیچیده، صرفاً به طور متناسب هزینهها را کاهش نمیدهد. وقتی از آستانهی مشخصی پایینتر میآید، مدل شروع به انحراف از مسیر میکند و هزینهی کلی رو به افزایش میگذارد. کاهش تلاش، در پرسوجوهای ساده باعث صرفهجویی در هزینه شد، اما در وظایف کدنویسی، هزینهها را به شدت افزایش داد.

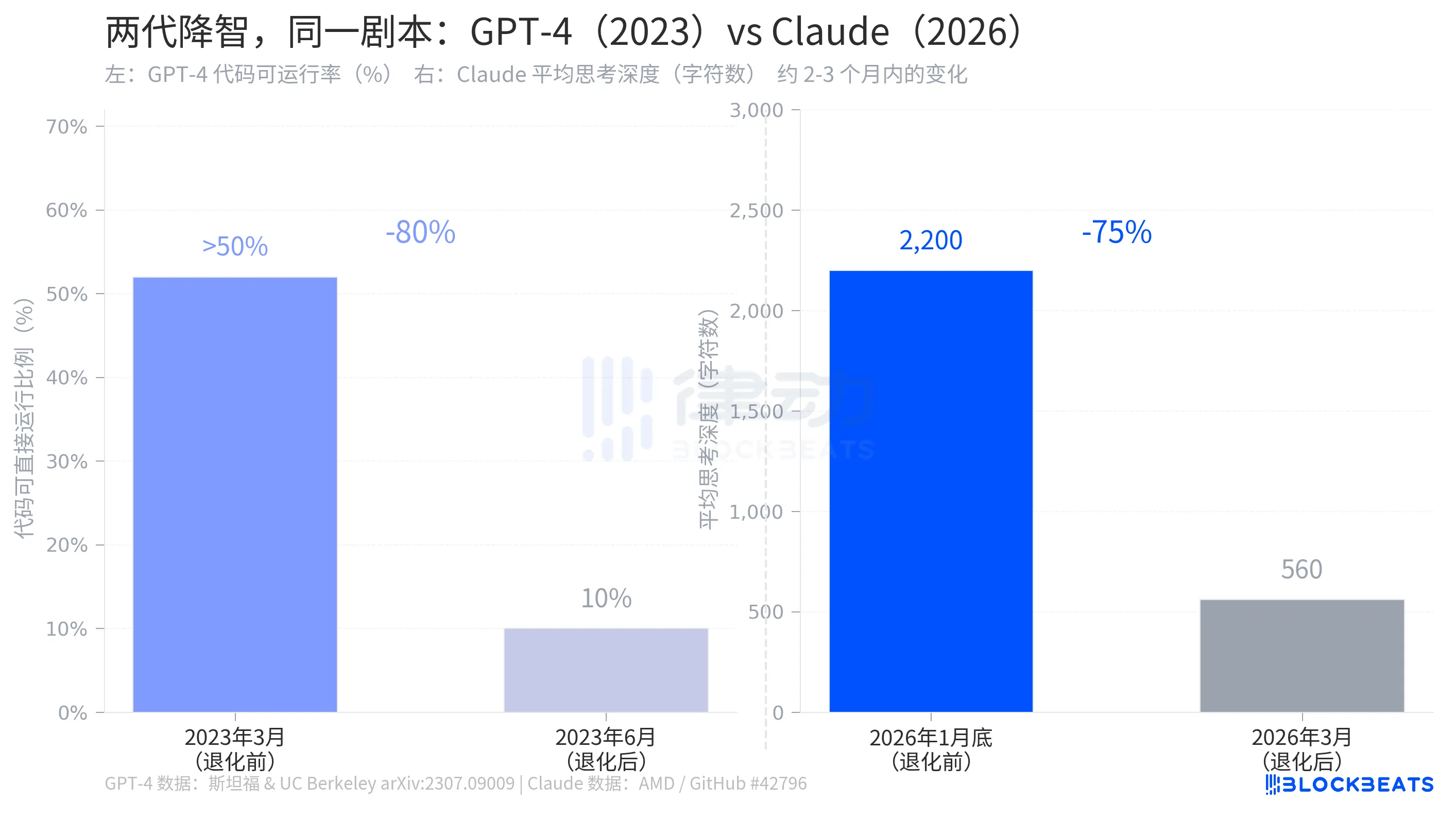

ماجرای «کوچکسازی»؛ GPT-4 سه سال پیش این کار را کرد

در ژوئیه ۲۰۲۳، یک تیم تحقیقاتی از دانشگاه استنفورد و دانشگاه کالیفرنیا، برکلی، مقالهای با عنوان «چگونه رفتار ChatGPT با گذشت زمان تغییر میکند؟» در arXiv منتشر کردند و همین پدیده را که در GPT-4 اتفاق میافتد، مستندسازی کردند.

طبق دادههای تحقیق، در مارس ۲۰۲۳، GPT-4 کدی تولید کرده بود که بیش از ۵۰٪ آن مستقیماً قابل اجرا بود. تا ماه ژوئن، این نسبت به ۱۰ درصد کاهش یافت که نشاندهندهی کاهش ۸۰ درصدی در طول سه ماه است. در همین دوره، دقت شناسایی اعداد اول از ۹۷.۶ درصد به ۲.۴ درصد کاهش یافت. پاسخ OpenAI بسیار شبیه به پاسخ Anthropic بود: بهینهسازیهایی در پسزمینه انجام شده بود که بخشی از تکرار عادی کار بود.

ساختار دو داستان تقریباً یکسان است: یک شرکت هوش مصنوعی بیسروصدا پارامترهایی را که در پسزمینه بر قابلیتهای مدل تأثیر میگذاشتند، تنظیم کرد، کاربران متوجه شدند، شرکت این تنظیم را تصدیق کرد، اما آن را «تخصیص منابع معقولتر» توضیح داد. زوال GPT-4 در سال ۲۰۲۳ و زوال کلود در سال ۲۰۲۶، با سه سال فاصله، رخ داد، اما متن هر دو یکسان است.

این اشتباه خاص یک شرکت خاص نیست. منطق اقتصادی مدلهای اشتراک هوش مصنوعی تعیین میکند که وقتی هزینههای استدلال از قیمتگذاری قابل پوشش بیشتر شود، تولیدکنندگان نیز با همان فشار مواجه میشوند. کاهش شدت تفکر پیشفرض در حال حاضر سادهترین راه برای تغییر بین هزینه و عملکرد است. چیزی که کاربران درک میکنند این است که مدل «هر روز احمقتر» میشود. چیزی که تولیدکننده در دفاتر صرفهجویی میکند، هزینه نهایی توکن به ازای هر تماس است.

بوریس چرنی یک راهکار فنی ارائه داده است که در آن کاربران میتوانند به صورت دستی شدت فکر را از طریق دستور /effort high یا با تغییر فایل پیکربندی به بالاترین سطح برگردانند. این راه حل از نظر فنی امکانپذیر است، اما همچنین به این معنی است که «حداکثر عملکرد» دیگر تنظیم پیشفرض نیست.

از ۳۴۵ دلار تا ۴۲۱۲۱ دلار، آنچه هزینه شده فقط بودجه نبوده، بلکه یک فرض نیز بوده است: تغییرات پیکربندی پیشفرض انجام شده توسط سازنده با هدف بهبود تجربه کاربری بوده است.

ممکن است شما نیز علاقهمند باشید

از ابزارهای قمار تا ماشینهای جهانی قیمتگذاری: دیدگاه رهبر NYSE درباره Hyperliquid

مدیرعامل Sharplink: آینده Ethereum در حال رقم خوردن است

یک دهه از سه موج توکنیزهسازی سهام در واقعیت Bitget: یک کاوش مالی ناتمام

آیا هکرها و مقررات، DeFi را نابود کردند؟

کریس لی: از پیشگامان کریپتو تا سرمایهگذاریهای کلان در سه غول صنعت حافظه، پیشبینی اصلاح بازار گاوی هوش مصنوعی، Web4 و فرصتها برای نسل جوان

برای قدم زدن در مسیر متفاوت Proof of Talk 2026 آمادهاید؟ به WEEX Labs در پاریس بپیوندید

اخبار صبح | همکاری Coinbase با بانک Standard Chartered برای گسترش کانالهای فیات چند ارزی؛ ورود Sharplink و Forward به شاخص راسل؛ احتمال صدور استیبلکوین توسط جیپیمورگان در آینده

رتبهبندی هه ییدنگ: حالا که اینجایی، بهتر است امتحانش کنی

دوران آربیتراژ رگولاتوری به پایان رسیده و ارزش مجوزهای صرافیهای ارز دیجیتال به شدت مورد رقابت است

شش شکایت عمده از یک توسعهدهنده اتریوم

حقیقت پرداختهای جهانی توسط Airwallex فاش شد

قسم سوم WEEX GOGOGO|مسیر لالیگا به سوی طلا – ۶ لحظه انفجاری، ۱ بلیت جام جهانی و شبی که هرگز فراموش نخواهد شد

چگونه Micron به ارزش بازار یک تریلیون دلاری دست یافت، در حالی که Samsung به چرخههای فناوری و Hynix به HBM متکی است؟

۲ سال، ۲۲۵ برابر بازدهی؟ رونمایی از تکنیک سرمایهگذاری «گلوگاه» هوش مصنوعی توسط پژوهشگر مرموز، Serenity

همکاری B.AI با BNB Chain برای راهاندازی جشن «یارانه توکن هوش مصنوعی میلیاردی» و شعلهور کردن اکوسیستم عاملهای هوشمند درونزنجیرهای

جنون تریلیون دلاری فروش حافظه؛ سود حاصل از خرید حافظه نصف شد

گزارش صبحگاهی | راهاندازی ابزار تحقیقاتی DYOR توسط Binance؛ راهاندازی پلتفرم استخدامی YZi Talent توسط YZi Labs؛ ویتالیک اعلام کرد که بنیاد اتریوم «کوچکسازی» شده و فروش ETH را کاهش میدهد