IOSG: From Compute to Intelligence, Reinforcement Learning-Driven Decentralized AI Investment Map

Original Title: "IOSG Weekly Brief | From Computing Power to Intelligence: Reinforcement Learning-Driven Decentralized AI Investment Map"

Original Author: Jacob Zhao, IOSG Ventures

Artificial Intelligence is transitioning from a primarily "Pattern Matching"-based statistical learning approach to a core capability system based on "Structured Reasoning." The importance of Post-training is rapidly increasing. The emergence of DeepSeek-R1 marks a paradigmatic shift for reinforcement learning in the era of large models. The industry has reached a consensus that Pre-training establishes a model's general capability foundation, and reinforcement learning is no longer just a value alignment tool. It has been proven to systematically improve the quality of the reasoning chain and the complexity of decision-making abilities. It is gradually evolving into a technical path for continuously enhancing intelligence.

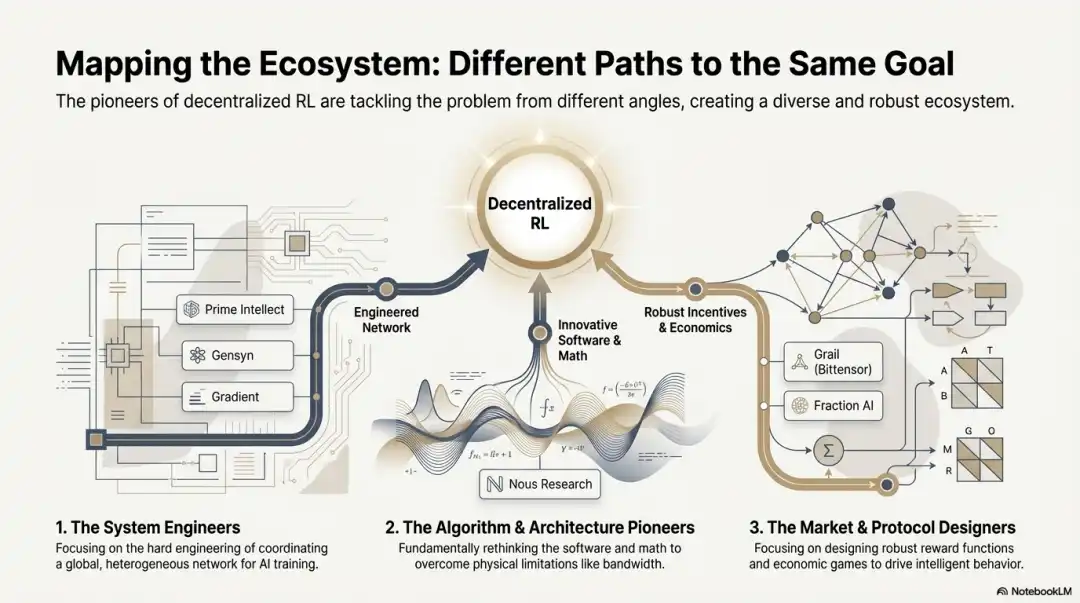

Meanwhile, Web3 is restructuring the production relationship of AI through a decentralized computing power network and a cryptographic incentive system. The structural requirements of reinforcement learning for rollout sampling, reward signals, and verifiable training align naturally with blockchain's collaborative computing power, incentive distribution, and verifiable execution. This research report will systematically dissect the AI training paradigm and the principles of reinforcement learning, demonstrate the structural advantages of Reinforcement Learning × Web3, and analyze projects such as Prime Intellect, Gensyn, Nous Research, Gradient, Grail, and Fraction AI.

Three Stages of AI Training: Pre-training, Instruction Fine-tuning, and Post-training Alignment

The full lifecycle of training modern Large Language Models (LLMs) is typically divided into three core stages: Pre-training, Supervised Fine-Tuning (SFT), and Post-training/RL. Each stage is responsible for "building a world model," "injecting task capabilities," and "shaping reasoning and values," with the computational structure, data requirements, and validation difficulties determining the degree of decentralization.

· Pre-training utilizes large-scale self-supervised learning to build the language statistical structure and cross-modal world model of the model, forming the foundation of LLM's capabilities. This stage requires training on a trillion-scale corpus in a globally synchronous manner, relying on homogeneous clusters of thousands to tens of thousands of H100s. The cost accounts for 80–95%, highly sensitive to bandwidth and data copyright, and must therefore be completed in a highly centralized environment.

· 微調(Supervised Fine-tuning)用於注入任務能力與指令格式,數據量小、成本占比約 5–15%,微調既可以進行全參數訓練,也可以採用參數高效微調(PEFT)方法,其中LoRA、Q-LoRA 與 Adapter 是工業界主流。但仍需同步梯度,使其去中心化潛力有限。

· 後訓練(Post-training)由多個迭代子階段構成,決定模型的推理能力、價值觀與安全邊界,其方法既包括強化學習體系(RLHF、RLAIF、GRPO)也包括無 RL 的偏好優化方法(DPO),以及過程獎勵模型(PRM)等。該階段數據量與成本較低(5–10%),主要集中在 Rollout 與策略更新;其天然支持異步與分佈式執行,節點無需持有完整權重,結合可驗證計算與鏈上激勵可形成開放的去中心化訓練網路,是最適配 Web3 的訓練環節。

強化學習技術全景:架構、框架與應用

強化學習的系統架構與核心環節

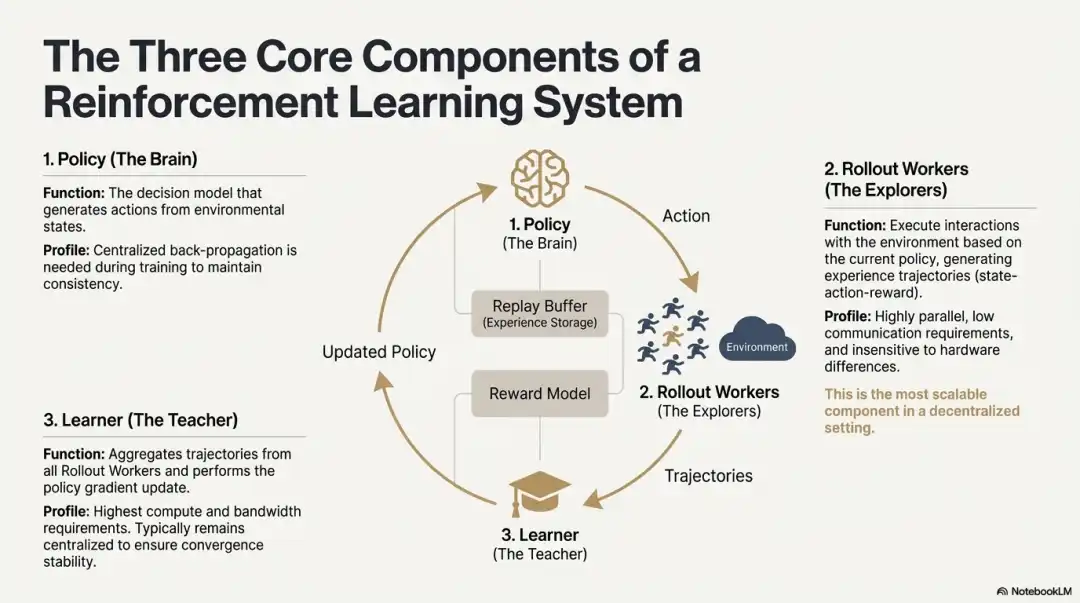

強化學習(Reinforcement Learning, RL)通過「環境交互—獎勵反饋—策略更新」驅動模型自主改進決策能力,其核心結構可視為由狀態、動作、獎勵與策略構成的反饋閉環。一個完整的 RL 系統通常包含三類組件:Policy(策略網路)、Rollout(經驗採樣)與 Learner(策略更新器)。策略與環境交互生成軌跡,Learner 根據獎勵信號更新策略,從而形成持續迭代、不斷優化的學習過程:

1. 策略網路(Policy):從環境狀態生成動作,是系統的決策核心。訓練時需集中式反向傳播維持一致性;推理時可分發至不同節點並行運行。

2. 經驗採樣(Rollout):節點根據策略執行環境互動,生成狀態—動作—獎勵等軌跡。該過程高度並行、通訊極低,對硬體差異不敏感是最適合在去中心化中擴展的環節。

3. 學習器(Learner):聚合全部 Rollout 軌跡並執行策略梯度更新,是唯一對算力、帶寬要求最高的模組,因此通常保持中心化或輕中心化部署以確保收斂穩定性。

強化學習階段框架(RLHF → RLAIF → PRM → GRPO)

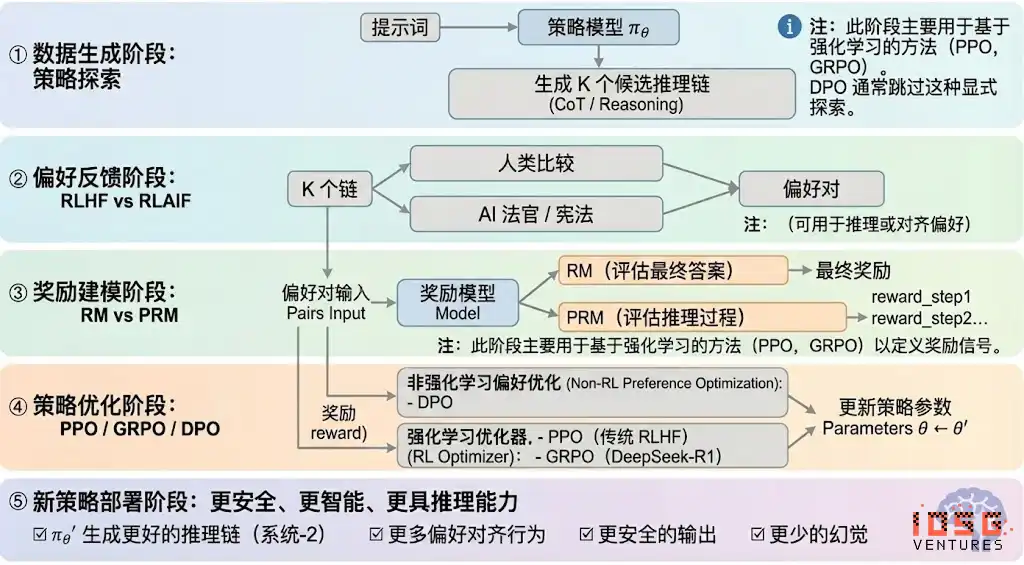

強化學習通常可分為五個階段,整體流程如下所述:

數據生成階段(Policy Exploration)

在給定輸入提示的條件下,策略模型 πθ 生成多條候選推理鏈或完整軌跡,為後續偏好評估與獎勵建模提供樣本基礎,決定了策略探索的廣度。

偏好反饋階段(RLHF / RLAIF)

· RLHF(Reinforcement Learning from Human Feedback)通過多候選回答、人工偏好標註、訓練獎勵模型(RM)並用 PPO 優化策略,使模型輸出更符合人類價值觀,是 GPT-3.5 → GPT-4 的關鍵一環

· RLAIF(Reinforcement Learning from AI Feedback)以 AI Judge 或憲法式規則取代人工標註,實現偏好獲取自動化,顯著降低成本並具備規模化特性,已成為 Anthropic、OpenAI、DeepSeek 等的主流對齊範式。

獎勵建模階段(Reward Modeling)

偏好對輸入獎勵模型,學習將輸出映射為獎勵。RM 教模型「什麼是正確答案」,PRM 教模型「如何進行正確推理」。

· RM(Reward Model) 用於評估最終答案的優劣,僅對輸出打分:

· 過程獎勵模型 PRM(Process Reward Model) 它不再僅評估最終答案,而是為每一步推理、每個 token、每個邏輯段打分,也是 OpenAI o1 與 DeepSeek-R1 的關鍵技術,本質上是在「教模型如何思考」。

獎勵驗證階段(RLVR / Reward Verifiability)

在獎勵信號生成與使用過程中引入「可驗證約束」,使獎勵尽可能來自可複現的規則、事實或共識,從而降低 reward hacking 與偏差風險,並提升在開放環境中的可審計性與可擴展性。

策略優化階段(Policy Optimization)

是在獎勵模型給出的信號指導下更新策略參數 θ,以得到更強推理能力、更高安全性與更穩定行為模式的策略 πθ′。主流優化方式包括:

· PPO(Proximal Policy Optimization): RLHF 的傳統優化器,以穩定性見長,但在複雜推理任務中往往面臨收斂慢、穩定性不足等局限。

· GRPO(Group Relative Policy Optimization):是 DeepSeek-R1 的核心創新,通過對候選答案組內優勢分布進行建模以估計期望價值,而非簡單排序。該方法保留了獎勵幅度信息,更適合推理鏈優化,訓練過程更穩定,被視為繼 PPO 之後面向深度推理場景的重要強化學習優化框架。

· DPO(Direct Preference Optimization):非強化學習的後訓練方法:不生成軌跡、不建獎勵模型,而是直接在偏好對上做優化,成本低、效果穩定,因而被廣泛用於 Llama、Gemma 等開源模型的對齊,但不提升推理能力。

新政策部署階段(New Policy Deployment)

經過優化後的模型表現為:更強的推理鏈生成能力(System-2 Reasoning)、更符合人類或 AI 偏好的行為、更低的幻覺率、更高的安全性。模型在持續迭代中不斷學習偏好、優化過程、提升決策質量,形成閉環。

強化學習的產業應用五大分類

強化學習(Reinforcement Learning)已從早期的博弈智能演進為跨產業的自主決策核心框架,其應用場景按照技術成熟度與產業落地程度,可歸納為五大類別,並在各自方向推動了關鍵突破。

· 博弈與策略系統(Game & Strategy):是 RL 最早被驗證的方向,在 AlphaGo、AlphaZero、AlphaStar、OpenAI Five 等「完美信息 + 明確獎勵」的環境中,RL 展示了可與人類專家比肩甚至超越的決策智能,為現代 RL 演算法奠定基礎。

· 機器人與具身智能(Embodied AI):RL 通過連續控制、動力學建模與環境交互,使機器人學習操控、運動控制和跨模態任務(如 RT-2、RT-X),正快速邁向產業化,是現實世界機器人落地的關鍵技術路線。

· 數位推理(Digital Reasoning / LLM System-2):RL + PRM 推動大模型從「語言模仿」走向「結構化推理」,代表成果包括 DeepSeek-R1、OpenAI o1/o3、Anthropic Claude 及 AlphaGeometry,其本質是在推理鏈層面進行獎勵優化,而非僅評估最終答案。

· 自動化科學發現與數學優化(Scientific Discovery):RL 在無標籤、複雜獎勵與巨大搜索空間中尋找最優結構或策略,已實現 AlphaTensor、AlphaDev、Fusion RL 等基礎突破,展現出超越人類直覺的探索能力。

· 經濟決策與交易系統(Economic Decision-making & Trading):RL 被用於策略優化、高維風險控制與自適應交易系統生成,相較傳統量化模型更能在不確定環境中持續學習,是智能金融的重要構成部分。

強化學習與 Web3 的天然匹配

強化學習(RL)與 Web3 的高度契合,源於二者本質上都是「激勵驅動系統」。RL 依賴獎勵信號優化策略,區塊鏈依靠經濟激勵協調參與者行為,使兩者在機制層面天然一致。RL 的核心需求——大規模異構 Rollout、獎勵分配與真實性驗證——正是 Web3 的結構優勢所在。

推理與訓練解耦

強化學習的訓練過程可明確拆分為兩個階段:

· Rollout (探索採樣):模型基於當前策略生成大量數據,計算密集型但通訊稀疏型的任務。它不需要節點間頻繁通訊,適合在全球分佈的消費級 GPU 上並行生成。

· Update (參數更新):基於收集到的數據更新模型權重,需高帶寬集中化節點完成。

「推理—訓練解耦」天然契合去中心化的異構算力結構:Rollout 可外包給開放網絡,通過代幣機制按貢獻結算,而模型更新保持集中化以確保穩定性。

可驗證性 (Verifiability)

ZK 與 Proof-of-Learning 提供了驗證節點是否真實執行推理的手段,解決了開放網絡中的誠實性問題。在代碼、數學推理等確定性任務中,驗證者只需檢查答案即可確認工作量,大幅提升去中心化 RL 系統的可信度。

激勵層,基於代幣經濟的反饋生產機制

Web3 的代幣機制可直接獎勵 RLHF/RLAIF 的偏好反饋貢獻者,使偏好數據生成具備透明、可結算、無需許可的激勵結構;質押與削減(Staking/Slashing)進一步約束反饋質量,形成比傳統眾包更高效且對齊的反饋市場。

多智能体強化學習(MARL)潛力

區塊鏈本質上是公開、透明、持續演化的多智能體環境,帳戶、合約與智能體不斷在激勵驅動下調整策略,使其天然具備構建大規模 MARL 實驗場的潛力。儘管仍在早期,但其狀態公開、執行可驗證、激勵可編程的特性,為未來 MARL 的發展提供了原則性優勢。

經典 Web3 + 強化學習專案解析

基於上述理論框架,我們將對當前生態中最具代表性的專案進行簡要分析:

Prime Intellect: 異步強化學習範式 prime-rl

Prime Intellect 致力於構建全球開放算力市場,降低訓練門檻、推動協作式去中心化訓練,並發展完整的開源超級智能技術棧。其體系包括:Prime Compute(統一雲/分布式算力環境)、INTELLECT 模型家族(10B–100B+)、開放強化學習環境中心(Environments Hub)、以及大規模合成數據引擎(SYNTHETIC-1/2)。

Prime Intellect 核心基礎設施組件 prime-rl 框架專為異步分布式環境設計與強化學習高度相關,其餘包括突破帶寬瓶頸的 OpenDiLoCo 通信協議、保障計算完整性的 TopLoc 驗證機制等。

Prime Intellect 核心基礎設施組件一覽

技術基石:prime-rl 異步強化學習框架

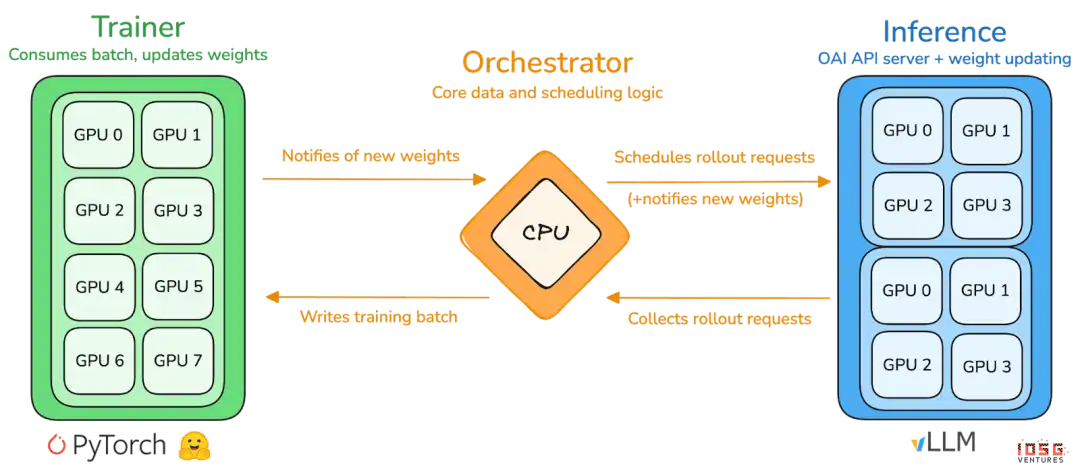

prime-rl 是 Prime Intellect 的核心訓練引擎,專為大規模異步去中心化環境設計,通過 Actor–Learner 完全解耦實現高吞吐推理與穩定更新。執行者 (Rollout Worker) 與學習者 (Trainer) 不再同步阻塞,節點可隨時加入或退出,只需持續拉取最新策略並上傳生成數據即可:

· 執行者 Actor(部署工作者):負責模型推理和數據生成。Prime Intellect 在 Actor 端革命性地集成了 vLLM 推理引擎。vLLM 的 PagedAttention 技術和連續批處理(Continuous Batching)能力使得執行者能夠以極高的吞吐量生成推理軌跡。

· 學習者 Learner(訓練者):負責策略優化。學習者從共享的經驗回放緩衝區(Experience Buffer)中異步拉取數據進行梯度更新,無需等待所有執行者完成當前批次。

· 協調器 Orchestrator:負責調度模型權重與數據流。

prime-rl 的關鍵創新點

· 完全異步 True Asynchrony:prime-rl 摒棄傳統 PPO 的同步範式,不等待慢節點、無需批次對齊,使任意數量與性能的 GPU 都能隨時接入,奠定去中心化 RL 的可行性。

· 深度集成 FSDP2 與 MoE:通過 FSDP2 參數切片與 MoE 稀疏激活,prime-rl 讓百億級模型在分佈式環境中高效訓練,執行者僅運行活躍專家,大幅降低顯存與推理成本。

· GRPO+(群組相對策略優化):GRPO 免除 Critic 網路,顯著減少計算與顯存開銷,天然適配異步環境,prime-rl 的 GRPO+ 更通過穩定化機制確保高延遲條件下的可靠收斂。

INTELLECT 模型家族:去中心化 RL 技術成熟度的標誌

INTELLECT-1(10B,2024 年 10 月)首次證明 OpenDiLoCo 能在跨三大洲的異構網路中高效訓練(通信占比 <2%、算力利用率 98%),打破跨地域訓練的物理認知;

智誠-2(32B,2025 年 4 月)作為首個無許可 RL 模型,驗證 prime-rl 與 GRPO+ 在多步延遲、異步環境中的穩定收斂能力,實現全球開放算力參與的去中心化 RL;

智誠-3(106B MoE,2025 年 11 月)採用僅啟動 12B 參數的稀疏架構,在 512×H200 上訓練並實現旗艦級推理性能(AIME 90.8%、GPQA 74.4%、MMLU-Pro 81.9% 等),整體表現已逼近甚至超越規模遠大於自身的中心化閉源模型。

Prime Intellect 此外還構建了數個支援性基礎設施:OpenDiLoCo 通過時間稀疏通信與量化權重差,將跨地域訓練的通信量降低數百倍,使智誠-1 在跨三洲網路仍保持 98% 利用率;TopLoc + Verifiers 形成去中心化可信執行層,以啟動指紋與沙箱驗證確保推理與獎勵數據的真實性;SYNTHETIC 數據引擎則生產大規模高質量推理鏈,並通過流水線並行讓 671B 模型在消費級 GPU 集群上高效運行。這些組件為去中心化 RL 的數據生成、驗證與推理吞吐提供了關鍵的工程底座。智誠 系列證明了這一技術棧可產生成熟的世界級模型,標誌著去中心化訓練體系從概念階段進入實用階段。

Gensyn: 強化學習核心棧 RL Swarm 與 SAPO

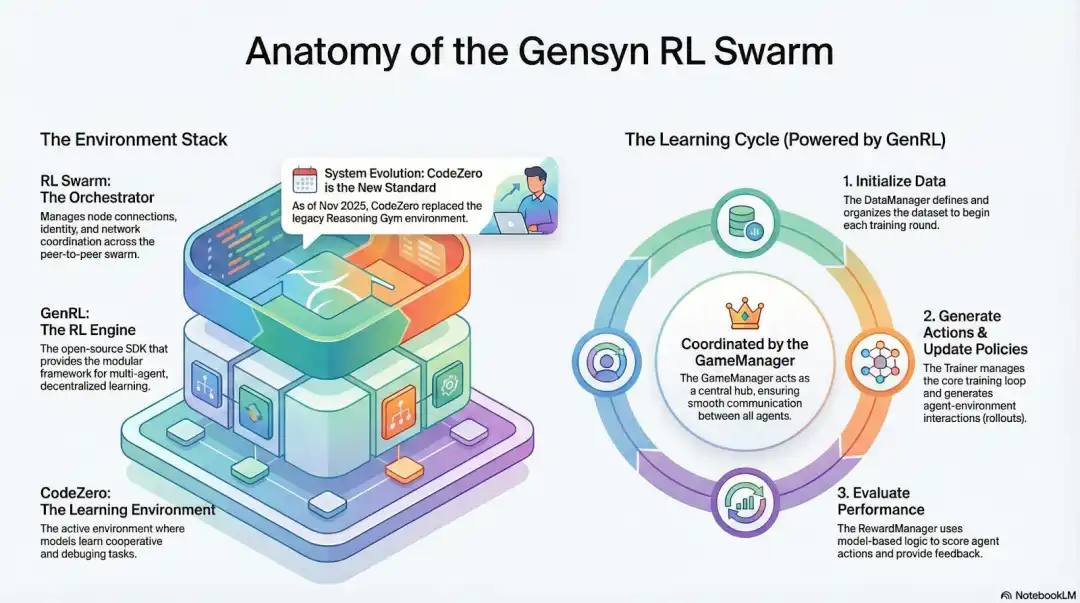

Gensyn 的目標是將全球閒置算力匯聚成一個開放、無需信任、可無限擴展的 AI 訓練基礎設施。其核心包括跨設備標準化執行層、點對點協調網路與無需信任的任務驗證系統,並通過智能合約自動分配任務與獎勵。圍繞強化學習的特點,Gensyn 引入 RL Swarm、SAPO 與 SkipPipe 等核心機制等機制,將生成、評估、更新三個環節解耦,利用全球異構 GPU 組成的「蜂群」實現集體進化。其最終交付的不是單純的算力,而是可驗證的智能(Verifiable Intelligence)。

Gensyn 堆疊的強化學習應用

RL Swarm:去中心化的協作式強化學習引擎

RL Swarm 展示了一種全新的協作模式。它不再是簡單的任務分發,而是一個模擬人類社會學習的去中心化的「生成—評估—更新」循環,類比協作式學習過程,無限循環:

· Solvers(執行者): 負責本地模型推理與 Rollout 生成,節點異構無礙。Gensyn 在本地整合高吞吐推理引擎(如 CodeZero),可輸出完整軌跡而非僅答案。

· Proposers(出題者): 動態生成任務(數學題、程式碼問題等),支持任務多樣性與類 Curriculum Learning 的難度自適應。

· Evaluators(評估者): 使用凍結的「裁判模型」或規則對本地 Rollout 進行評估,生成本地獎勵信號。評估過程可被稽核,減少惡意空間。

三者共同組成一個 P2P 的 RL 組織結構,無需中心化調度即可完成大規模協作學習。

SAPO:為去中心化重構的策略優化算法

SAPO(Swarm Sampling Policy Optimization)以「共享 Rollout 並過濾無梯度信號樣本,而非共享梯度」為核心,通過大規模去中心化的 Rollout 取樣,並將接收的 Rollout 視為本地生成,從而在無中心協調、節點延遲差異顯著的環境中保持穩定收斂。相較依賴 Critic 網路、計算成本較高的 PPO,或基於組內優勢估計的 GRPO,SAPO 以極低帶寬使消費級 GPU 也能有效參與大規模強化學習優化。

通過 RL Swarm 與 SAPO,Gensyn 證明了強化學習(尤其是後訓練階段的 RLVR)天然適配去中心化架構——因為其更依賴於大規模、多樣化的探索(Rollout),而非高頻參數同步。結合 PoL 與 Verde 的驗證體系,Gensyn 為兆級參數模型的訓練提供了一條不再依賴單一科技巨頭的替代路徑:一個由全球數百萬異構 GPU 組成的、自我演化的超級智能網路。

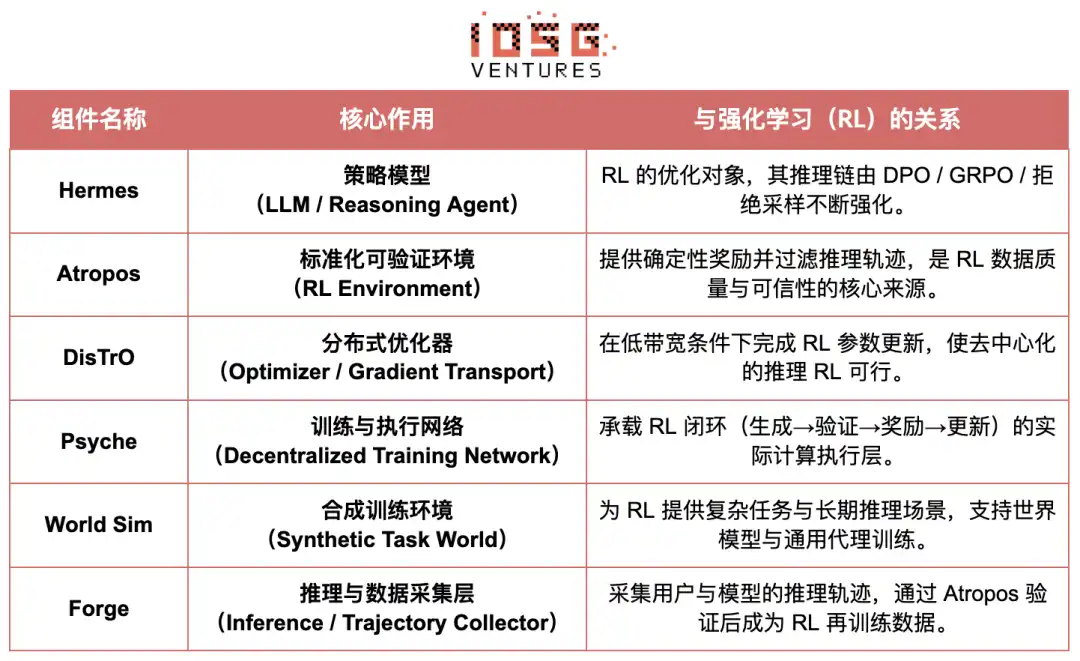

Nous Research:可驗證強化學習環境 Atropos

Nous Research 正在構建一套去中心化、可自我進化的認知基礎設施。其核心組件——Hermes、Atropos、DisTrO、Psyche 與 World Sim 被組織成一個持續閉環的智能演化系統。不同於傳統「預訓練—後訓練—推理」線性流程,Nous 採用 DPO、GRPO、拒絕採樣等強化學習技術,將數據生成、驗證、學習與推理統一為連續反饋回路,打造持續自我改進的閉環 AI 生態。

Nous Research 組件總覽

模型層:Hermes 與推理能力的演進

Hermes 系列是 Nous Research 面向用戶的主要模型介面,其演進清晰展示了行業從傳統 SFT/DPO 對齊向推理強化學習(Reasoning RL)遷移的路徑:

· Hermes 1–3:指令對齊與早期代理能力:Hermes 1–3 依賴低成本 DPO 完成穩健指令對齊,並在 Hermes 3 借助合成數據與首次引入的 Atropos 驗證機制。

· Hermes 4 / DeepHermes:通過思維鍊將 System-2 式慢思考寫入權重,以 Test-Time Scaling 提升數學與程式碼性能,並依賴「拒絕採樣 + Atropos 驗證」構建高純度推理數據。

· DeepHermes 進一步採用 GRPO 替代難以分佈式落地的 PPO,使推理 RL 能在 Psyche 去中心化 GPU 網路上運行,為開源推理 RL 的可擴展化奠定工程基礎。

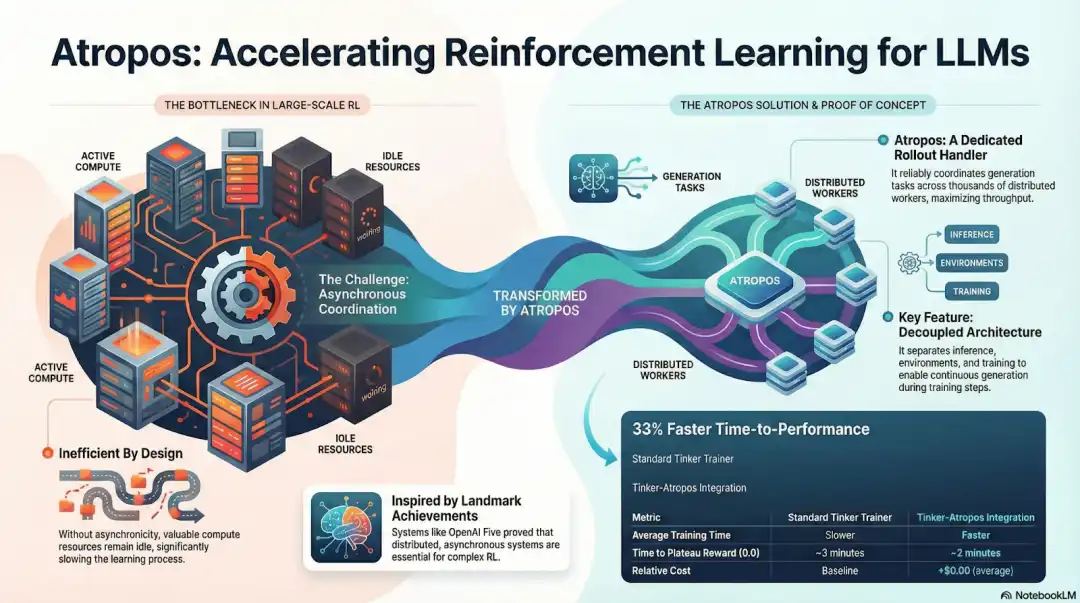

Atropos:可驗證獎勵驅動的強化學習環境

Atropos 是 Nous RL 體系的真正樞紐。它將提示、工具呼叫、程式碼執行和多輪交互封裝成標準化 RL 環境,可直接驗證輸出是否正確,從而提供確定性獎勵信號,替代昂貴且不可擴展的人類標註。更重要的是,在去中心化訓練網路 Psyche 中,Atropos 充當「裁判」,用於驗證節點是否真實提升策略,支持可審計的 Proof-of-Learning,從根本上解決分佈式 RL 中的獎勵可信性問題。

DisTrO 與 Psyche:去中心化強化學習的優化器層

傳統 RLF(RLHF/RLAIF)訓練依賴中心化高帶寬集群,這是開源無法複製的核心壁壘。DisTrO 通過動量解耦與梯度壓縮,將 RL 的通信成本降低幾個數量級,使訓練能夠在互聯網帶寬上運行;Psyche 則將這一訓練機制部署在鏈上網絡,使節點可以在本地完成推理、驗證、獎勵評估與權重更新,形成完整的 RL 閉環。

在 Nous 的體系中,Atropos 驗證思維鏈;DisTrO 壓縮訓練通信;Psyche 運行 RL 迴圈;World Sim 提供複雜環境;Forge 採集真實推理;Hermes 將所有學習寫入權重。強化學習不僅是一個訓練階段,而是 Nous 架構中 連接數據、環境、模型與基礎設施的核心協議,讓 Hermes 成為一個 能在開源算力網絡上持續自我改進的活體系統。

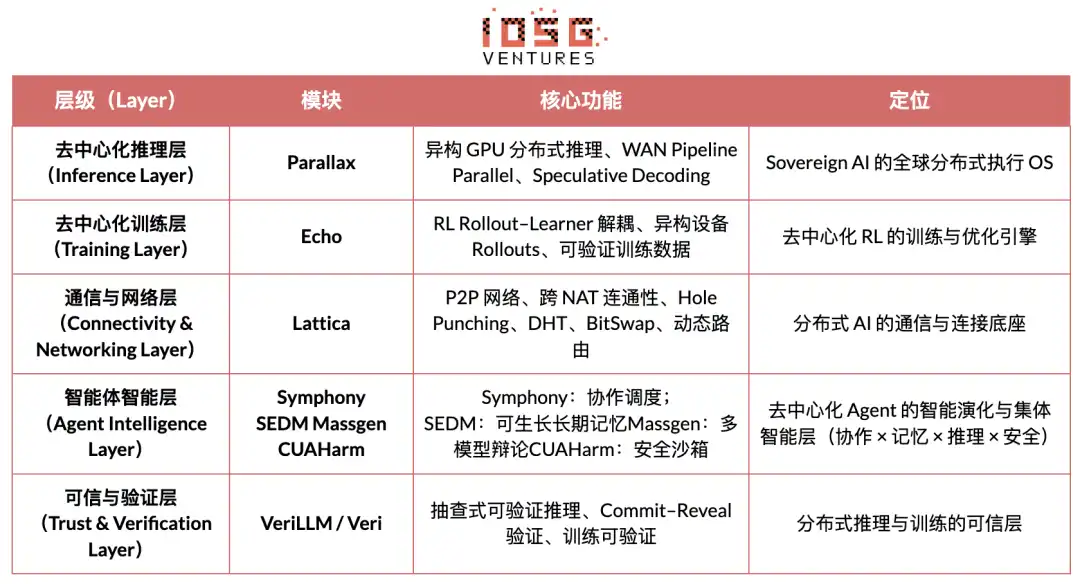

Gradient Network:強化學習架構 Echo

Gradient Network 核心願景是通過「開放智能協議棧」(Open Intelligence Stack)重構 AI 的運算範式。Gradient 的技術棧由一組可獨立演化、又異構協同的核心協議組成。其體系從底層通信到上層智能協作依次包括:Parallax(分佈式推理)、Echo(去中心化 RL 訓練)、Lattica(P2P 網絡)、SEDM / Massgen / Symphony / CUAHarm(記憶、協作、安全)、VeriLLM(可信驗證)、Mirage(高保真仿真),共同構成持續演化的去中心化智能基礎設施。

Echo—強化學習訓練架構

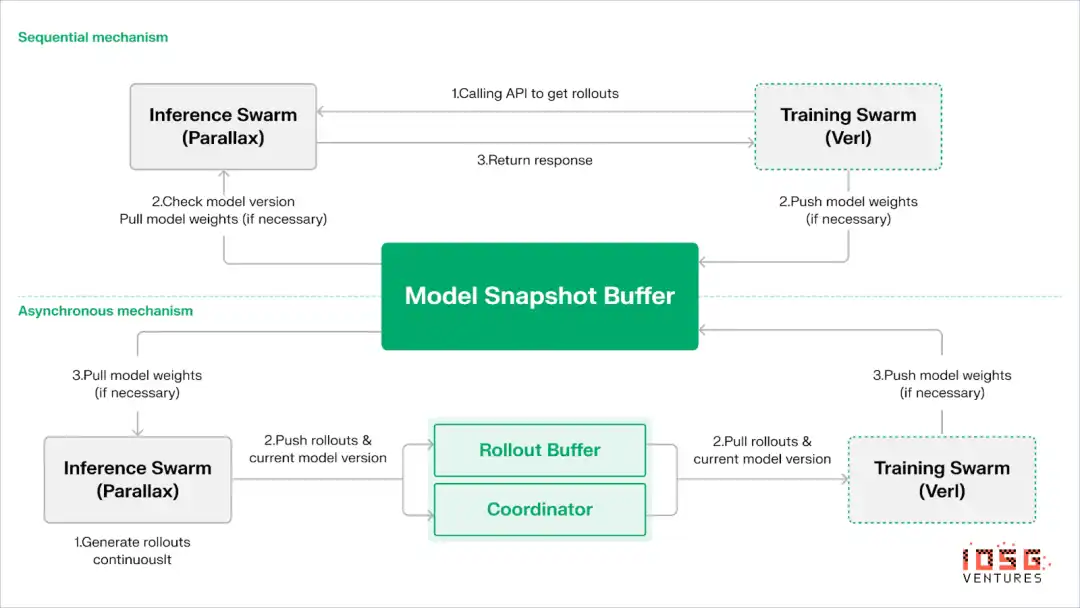

Echo 是 Gradient 的強化學習框架,其核心設計理念在於解耦強化學習中的訓練、推理與數據(獎勵)路徑,使 Rollout 生成、策略優化與獎勵評估能夠在異構環境中獨立擴展與調度。在由推理側與訓練側節點組成的異構網絡中協同運行,以輕量同步機制在廣域異構環境中維持訓練穩定性,有效緩解傳統 DeepSpeed RLHF / VERL 中推理與訓練混跑導致的 SPMD 失效與 GPU 利用率瓶頸。

Echo 採用「推理–訓練雙群架構」實現算力利用最大化,雙群各自獨立運行,互不阻塞:

· 最大化採樣吞吐:推理群 Inference Swarm 由消費級 GPU 與邊緣設備組成,通過 Parallax 以 pipeline‐parallel 構建高吞吐採樣器,專注於軌跡生成;

· 最大化梯度算力:訓練群 Training Swarm 由可運行於中心化集群或全球多地的消費級 GPU 網路,負責梯度更新、參數同步與 LoRA 微調,專注於學習過程。

為維持策略與數據的一致性,Echo 提供順序(Sequential)與異步(Asynchronous)兩類輕量級同步協議,實現策略權重與軌跡的雙向一致性管理:

· 順序拉取(Pull)模式|精度優先:訓練側在拉取新軌跡前強制推理節點刷新模型版本,從而確保軌跡新鮮度,適合對策略陳舊高度敏感的任務;

· 異步推拉(Push–Pull)模式|效率優先:推理側持續生成帶版本標籤的軌跡,訓練側依自身節奏消費,協調器監控版本偏差並觸發權重刷新,最大化設備利用率。

在底層,Echo 構建於 Parallax(低帶寬環境下的異構推理)與輕量化分佈式訓練組件(如 VERL) 之上,依賴 LoRA 降低跨節點同步成本,使強化學習可在全球異構網路上穩定運行。

Grail:Bittensor 生態的強化學習

Bittensor 透過其獨特的 Yuma 共識機制,構建了一個巨大的、稀疏的、非平穩的獎勵函數網路。

Bittensor 生態中的 Covenant AI 則通過 SN3 Templar、SN39 Basilica 與 SN81 Grail 構建了從預訓練到 RL 後訓練的垂直一體化流水線。其中,SN3 Templar 負責基礎模型的預訓練,SN39 Basilica 提供分佈式算力市場,SN81 Grail 則作為面向 RL 後訓練的「可驗證推理層」,承載 RLHF / RLAIF 的核心流程,完成從基礎模型到對齊策略的閉環優化。

GRAIL 的目標是以加密方式證明每個強化學習 rollout 的真實性與模型身份綁定,確保 RLHF 能夠在無需信任的環境中被安全執行。協議通過三層機制建立可信鏈條:

1. 確定性挑戰生成:利用 drand 隨機信標與區塊哈希生成不可預測但可複現的挑戰任務(如 SAT、GSM8K),杜絕預計算作弊;

2. 通過 PRF 索引採樣與 sketch commitments,使驗證者以極低成本抽檢 token-level logprob 與推理鏈,確認 rollout 確由聲明模型生成;

3. 模型身份綁定:將推理過程與模型權重指紋及 token 分布的結構性簽名綁定,確保替換模型或結果重放都會被立即識別。由此,為 RL 中推理軌跡(rollout)提供了真實性根基。

在此機制上,Grail 子網實現了 GRPO 風格的可驗證後訓練流程:礦工為同一題目生成多條推理路徑,驗證者依據正確性、推理鏈質量與 SAT 滿足度評分,並將歸一化結果寫入鏈上,作為 TAO 權重。公開實驗顯示,該框架已將 Qwen2.5-1.5B 的 MATH 準確率從 12.7% 提升至 47.6%,證明其既能防作弊,也能顯著強化模型能力。在 Covenant AI 的訓練堆中,Grail 是去中心化 RLVR/RLAIF 的信任與執行基石,目前尚未正式主網上線。

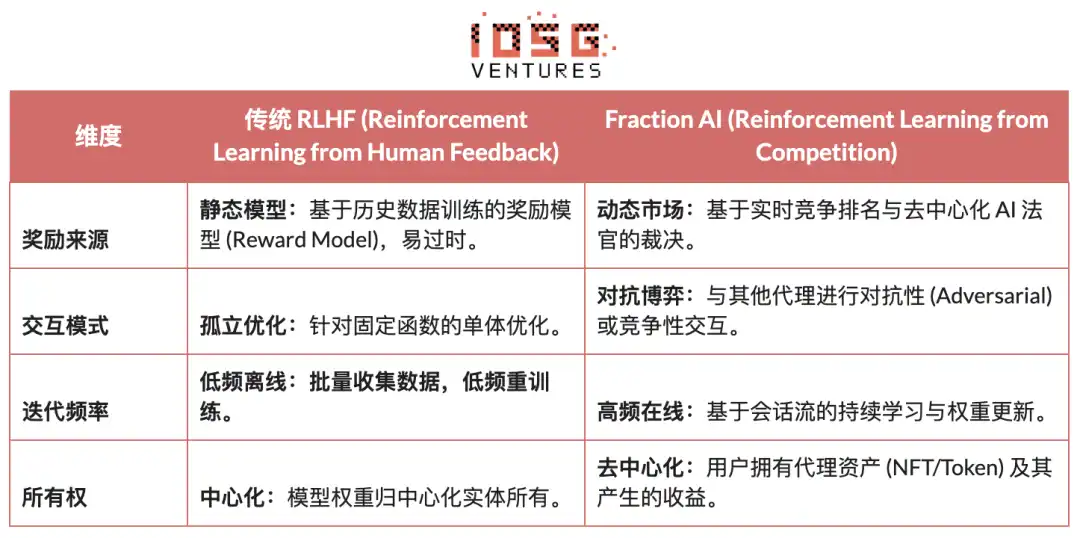

Fraction AI:基於競爭的強化學習 RLFC

Fraction AI 的架構明確圍繞競爭強化學習(Reinforcement Learning from Competition, RLFC)和遊戲化數據標註構建,將傳統 RLHF 的靜態獎勵與人工標註替換為開放、動態的競爭環境。代理在不同 Spaces 中對抗,其相對排名與 AI 法官評分共同構成實時獎勵,使對齊過程演變為持續線上的多智能體博弈系統。

傳統 RLHF 與 Fraction AI 的 RLFC 之間的核心差異:

RLFC 的核心價值在於獎勵不再來自單一模型,而來自不斷演化的對手與評估者,避免獎勵模型被利用,並通過策略多樣性防止生態陷入局部最優。Spaces 的結構決定博弈性質(零和或正和),在對抗與合作中推動複雜行為湧現。

在系統架構上,Fraction AI 將訓練過程拆解為四個關鍵組件:

· Agents:基於開源 LLM 的輕量策略單元,通過 QLoRA 以差分權重擴展,低成本更新;

· Spaces:隔離的任務域環境,代理付費進入並以勝負獲得獎勵;

· AI Judges:以 RLAIF 構建的即時獎勵層,提供可擴展、去中心化的評估;

· Proof-of-Learning:將策略更新綁定到具體競爭結果,確保訓練過程可驗證、防作弊。

Fraction AI 的本質是構建了一個人機協同的進化引擎」。用戶作為策略層的「元優化者」(Meta-optimizer),通過提示工程(Prompt Engineering)和超參配置引導探索方向;而代理在微觀的競爭中自生成海量的高質量偏好數據對 (Preference Pairs)。這種模式讓數據標註通過「去信任化微調」(Trustless Fine-tuning) 實現了商業閉環。

強化學習 Web3 項目架構比較

總結與展望:強化學習 × Web3 的路徑與機會

基於對上述前沿項目的解構分析,我們觀察到:儘管各團隊的切入點(算法、工程或市場)各異,但當強化學習(RL)與 Web3 結合時,其底層架構邏輯皆收斂為一個高度一致的「解耦-驗證-激勵」範式。這不僅是技術上的巧合,更是去中心化網絡適配強化學習獨特屬性的必然結果。

強化學習通用架構特徵:解決核心的物理限制與信任問題

1. 推訓物理分離(Decoupling of Rollouts & Learning)——默認計算拓撲

通信稀疏、可並行的 Rollout 外包給全球消費級 GPU,高帶寬的參數更新集中於少量訓練節點,從 Prime Intellect 的異步 Actor–Learner 到 Gradient Echo 的雙群架構皆如此。

2. 驗證驅動的信任層(Verification-Driven Trust)——基礎設施化

在無需許可的網路中,計算真實性必須通過數學與機制設計強制保障,代表實現包括 Gensyn 的 PoL、Prime Intellect 的 TOPLOC 與 Grail 的密碼學驗證。

3. 代幣化的激勵閉環(Tokenized Incentive Loop)——市場自我調節

算力供給、數據生成、驗證排序與獎勵分配形成閉環,通過獎勵驅動參與、通過 Slash 抑制作弊,使網路在開放環境中依然保持穩定與持續演進。

差異化技術路徑:一致架構下的不同「突破點」

儘管架構趨同,但各專案根據自身基因選擇了不同的技術護城河:

· 算法突破派(Nous Research):試圖從數學底層解決分佈式訓練的根本矛盾(帶寬瓶頸)。其 DisTrO 優化器旨在將梯度通信量壓縮數千倍,目標是讓家庭寬帶也能跑得動大模型訓練,這是對物理限制的「降維打擊」。

· 系統工程派(Prime Intellect、Gensyn、Gradient):側重於構建下一代的「AI 運行時系統」。Prime Intellect 的 ShardCast 和 Gradient 的 Parallax 都是為了在現有的網路條件下,通過極致的工程手段壓榨出最高的異構集群效率。

· 市場博弈派(Bittensor、Fraction AI):專注獎勵函數(Reward Function)的設計。通過設計精妙的評分機制,引導礦工自發尋找最優策略,來加速智能湧現。

優勢、挑戰與終局展望

在強化學習與 Web3 結合的範式下,系統級優勢首先體現在成本結構與治理結構的重寫。

· 成本重塑:RL 後訓練(Post-training)對採樣(Rollout)的需求是無限的,Web3 能以極低成本調動全球長尾算力,這是中心化雲廠商難以比擬的成本優勢。

· 主權對齊(Sovereign Alignment):打破大廠對 AI 價值觀(Alignment)的壟斷,社區可以通過 Token 投票決定模型「什麼是好的回答」,實現 AI 治理的民主化。

與此同時,這一體系也面臨兩大結構性約束。

· 帶寬牆(Bandwidth Wall):儘管有 DisTrO 等創新,物理延遲仍限制了超大參數模型(70B+)的全量訓練,目前 Web3 AI 更多局限於微調和推理。

· 古德哈特定律(Reward Hacking):在高度激勵的網絡中,礦工極易「過擬合」獎勵規則(刷分)而非提升真實智能。設計防作弊的魯棒獎勵函數是永恆的博弈。

· 惡意拜占庭式節點攻擊(BYZANTINE worker):通過對訓練信號的主動操控與投毒破壞模型收斂。核心不在於持續設計防作弊的獎勵函數,而在於構建具備對抗性魯棒性的機制。

強化學習與 Web3 的結合,本質是在重寫「智能是如何被生產、對齊並分配價值」的機制。其演進路徑可概括為三條互補方向:

1. 去中心化推訓網絡:從算力礦機到策略網絡,將並行且可驗證的 Rollout 外包給全球長尾 GPU,短期聚焦可驗證推理市場,中期演化為按任務聚類的強化學習子網;

2. 偏好與獎勵的資產化:從標註勞工到數據股權。實現偏好與獎勵的資產化,將高質量反饋與 Reward Model 變為可治理、可分配的數據資產,從「標註勞工」升級為「數據股權」

3. 垂直領域的「小而美」進化:在結果可驗證、收益可量化的垂直場景中孵化小而強的專用 RL Agents,如 DeFi 策略執行、程式碼生成,使策略改進與價值捕獲直接綁定並有望跑贏通用閉源模型。

總體來看,強化學習 × Web3 的真正機會不在於複製一個去中心化版 OpenAI,而在於重寫「智能生產關係」:讓訓練執行成為開放算力市場,讓獎勵與偏好成為可治理的鏈上資產,讓智能帶來的價值不再集中於平台,而在訓練者、對齊者與使用者之間重新分配。

猜你喜歡

加密巨頭 Kraken 的財技門道

當主動做市商開始主動出擊

匈牙利選舉震蕩:加密政策和監管或將重啟辯論

在2026年4月12日,彼得·馬加爾 (Péter Magyar)的親歐盟Tisza黨贏得壓倒性多數,結束了奧班16年的掌權,為打破匈牙利嚴苛的加密貨幣政策提供了可能。 政治上的改變已確認,但監管的逆轉尚未確定,這對交易者和運營者有深遠影響。 新政府若想撤銷現行措施,需要按序進行立法、監管和外交的三個機構行動。 歐盟的侵權程序是最可能快速解決匈牙利加密監管問題的途徑。 Tisza政黨的親歐立場可能加快與歐盟的和解進程,從而繞過全面的立法改革。 WEEX Crypto News, 匈牙利加密打壓背後的架構與選後改革需拆的障礙 匈牙利的加密打壓架構看似嚴厲,但實則更具針對性。從2025年7月1日起,新增了“加密濫用”和“未授權加密交易服務”兩項刑事罪,最高可處以2年監禁。這些措施主要針對大規模未經驗證的交易和未獲許可的平台,而不涉及比特幣持有或個人使用國際交易平台。 到2025年底,SARA許可證已成為實施交易所需的必要條件。這一狀況使得匈牙利成為以國家之力引導市場權力流向獲許可的本土運營商,而非國外的平台。像Revolut這樣的公司,因政策已完全禁止匈牙利用戶購買或存放加密貨幣。 任何政策逆轉需要先撤銷SARA驗證制度,然後修改或廢除刑事條款,最後還要與歐盟合作結束相關的違規程序。這三項並非一蹴而就,即便有新的政府提倡親歐政策,具體執行依然需要時間和多方協調。 [Place Image: SARA驗證流程示意圖] 歐盟對匈牙利監管架構影響…

新「數據資產」法規:為何AI代理可能移居馬恩島

馬恩島的Tynwald通過了2025年《基礎法(修正案)》,開創全球首例承認數據為法律資產的法規。 該法規為去中心化AI協議提供了所需的法律基礎,以數據作為合法資產運營。 新法框架解決了AI項目的數據治理、數據所有權及資金獲取三大核心問題。 在全球主要法域缺乏統一法律框架的狀態下,馬恩島提供了一個獨特的法律環境。 這一改變使得數據從無形資產轉變為可在財務報表中體現的有形資產。 WEEX Crypto News, 2025年《基礎法(修正案)》對DeAI營運者的實質變革 《基礎法(修正案)》創建了一個新的法律實體——數據資產基金會(DAF),該實體根據2011年《基礎法》架構,將數據視為其主要資產。這不僅填補了法律縫隙,還賦予去中心化AI協議更大的權利和可能性。 DeAI協定可以將訓練數據集存放在DAF內,並賦予數據正式的法律地位。此外,這種框架提供了可審計且可執行的數據治理規則,保障社群成員貢獻數據時的所有權與透明度,並提供了一個穩固的法律機制來處理數據資產交易。 相比英國、美國和歐盟的做法,馬恩島的制度為AI公司提供了更為清晰的法律路徑。英國擬在2023年引入數字資產的第三類財產類別,但尚未實施具體立法;美國則在不同領域內各成一體,缺乏統一的法律框架;而歐盟則專注於數據存取與可攜性,而非數據的資產化。 DAF的設立對數據治理的影響 DAF提供的不是簡單的法律地位,而是實現了數據治理的跨越式變革。它不僅改善了AI模型的數據來源合法性,還為資本市場進一步融入提供了穩固基礎。 數據策略負責人Aga Strandskov指出,缺乏可信賴的法律框架一直是使用數據的最大障礙,新法案正是解決了這個問題。而曼恩Benham的總經理Miles Benham則進一步提到,馬恩島傳統的博彩業將從此受益,因為它們昔日的數據資產終於可以得到法律承認。 如同日本將加密貨幣重新分類為金融工具一樣,馬恩島的法規將數據從模糊不清的狀態轉變為法律承認的資產,這無疑為數據的商業化提供了可行的基礎。…

川普加密貨幣巨鯨聚集:午餐會前的幕後動作

TRUMP 代幣價格約為 $2.80,持有超過一百萬代幣的錢包已增至 83 個。 4月25日在佛羅里達的 Mar-a-Lago,將舉行限量 297 名代幣持有者參加的加密午餐會。 大鯨錢包“8DHkza”從 Bybit 提取了超過 85 萬枚 TRUMP 代幣。 供應數據顯示,91% 的…

以太坊價格預測:黃金三角形將使ETH呈拋物線上升

以太坊價格目前在2200美元上下波動,預示着可能出現劇烈上升。 分析師指出一個黃金三角形結構,通過ETH的圖表預測未來將突破12,000美元。 2026年底,以太坊可能會觸及7500美元。 宏觀市場中存在恐慌情緒,恐懼與貪婪指數顯示深度恐懼。 以太坊的供應量正在減少,且機構資金流入增多。 WEEX Crypto News, 以太坊價格預測:2026年底有望突破7500美元 ETH目前的價格在2000至2200美元之間整合,最近跌至2000美元後的波動率為3.89%。分析指出,雖然市場恐慌情緒高漲,但賣方的勢頭逐漸減弱。技術指標顯示,如果能有效持守2090美元的移動平均線,未來有望回升至2400美元,並挑戰黃金三角形以突破7500美元的目標,甚至在2027年升至15,000美元。[Place Image: ETH價格走勢圖] 擁有早期優勢的比特幣超目標 目標價格定在7500美元的ETH需要從目前的價格實現3.5倍的增長。就一些市場上的早期投資機會而言,比特幣超目標型項目已經吸引了大量的預售資金。該項目宣稱可以在比特幣的安全層上引入Solana的虛擬機整合,增加智能合約的速度和拓展能力。抵達迅速的期望是基於它的核心理念,訴求解決比特幣交易速度慢、費用高和缺少編程能力的問題,而不損害比特幣的信任模式。在預售期間,該項目已籌集超過3200萬美元,並提供代幣抵押。[Place Image: 比特幣超目標項目的圖示] 問題解答 預測中的黃金三角形是什麼?…

黑客通過Polkadot橋鑄造10億DOT加密代幣

Polkadot橋被發現存在漏洞,黑客鑄造了10億個DOT代幣,價格迅速下跌7%。 該漏洞源於Hyperbridge的跨鏈驗證層,被安全公司Certik確認。 Dot的流通受限於南韓Upbit與Bithumb的交易所,防止更大的市場波動。 LiquidChain正在解決跨鏈流動性問題,並融合比特幣、以太坊與Solana的資源。 該事件顯示了橋接架構的潛在風險,影響了市場信心。 WEEX Crypto News, Polkadot橋漏洞詳情 一名利用Hyperbridge入口的黑客成功鑄造10億DOT代幣,撼動市場信心。該事件造成DOT價格瞬跌7%,成為近期加密市場上最大的波動之一。目前已有相關安全企業確認漏洞所在,並提出進一步安全修復的建議。[插圖位置:顯示瞬間價格變動的圖表] 技術影響與市場反應 此漏洞可能不是孤立事件,而是深層次風險的體現。儘管OdorsRouter與Uniswap V4的有限流動性抑制了更大損失,南韓的主要交易所如Upbit與Bithumb暫停了DOT的存取,影響其短期交易量和市場流動性。此舉也使市場反彈空間受到限制。[插圖位置:顯示交易所公告截圖] LiquidChain的流動性優勢 由此跨鏈漏洞事件指出,現階段加密橋接往往是潛在失誤的集中區域。LiquidChain正以其Layer 3架構躋身於解決此類問題的前沿,致力於打造統一流動層合約,不再依賴傳統橋接。其獨特賣點包括單步執行與可驗證結算功能。該公司目前的預售價格為每枚LIQUID $0.01449,已籌得$657,066.97。[插圖位置:LiquidChain生態系統解釋圖] DOT能否重整旗鼓?…

XRP 價格預測:底部信號顯現?是時機出手?

XRP 現在交易於微幅上升,儘管過去八個月走勢悲觀。 技術指標顯示 RSI 價值在 XRP/BTC 比例中降至 23,暗示強烈的購買機會。 鏈上的 MVRV Z-score 也接近歷史上每次大漲前的積累階段。 現行 Fear & Greed Index 為…

比特幣價格預測:Arthur Hayes對AI、石油價格及加密貨幣挑戰的看法

Arthur Hayes預測比特幣到2026年底可能達到50萬到75萬美元,但面臨的挑戰包括AI驅動的知識工人失業潮。 目前比特幣價格約為70,700美元,主要技術阻力位於76,000美元,而AI引起的市場壓力可能讓價格維持在70K至74K之間。 Hayes認為比特幣像是「流動性警報器」,需等到信用市場放水才會大幅波動。 LiquidChain正致力於解決跨鏈流動性問題並提升開發者效率。 投資策略仍需考慮地緣政治緊張和AI導致的市場動盪。 WEEX Crypto News, 2026 比特幣價格預測:戰爭與AI影響 在2026年底之前,比特幣價格可能在50萬至75萬美元之間,但流動性挑戰與AI驅動的失業潮形成的通縮壓力對市場情緒造成影響。目前比特幣價格約為70,700美元,主要阻力位於76,000美元。如以色列與伊朗的衝突引發緊急流動性措施,比特幣有望突破這一阻力。 [Place Image: Screenshot of Bitcoin price…

白宮加密顧問表示明確法案面臨的其他障礙正逐步清除

白宮主要加密顧問 Patrick Witt 表示,近期參議院達成的穩定幣收益妥協方案可能持續推進數位資產市場明確法案。 雖然穩定幣收益問題被解決了,但去中心化金融(DeFi)中的非法金融保護等其他問題仍需解決。 談判過程中已解決的問題讓 Witt 有信心接下來的障礙也能克服。 參議院銀行委員會需要進行法案標記聽證,才能推進至最終參議院投票。 WEEX Crypto News, 最新進展:數位資產市場明確法案 Patrick Witt 詳述了關於明確法案的最新進展,尤其是針對穩定幣收益的爭議解決方案。這一方案已被參議院的關鍵性成員所接受,為其他問題的清理鋪平了道路。白宮希望這一協議能持久有效,並幫助解決其他尚未解決的問題。 穩定幣收益:銀行的憂慮與白宮的回應 銀行業對穩定幣持有者的收益可能威脅到其存款基礎表示擔憂。雖然白宮的經濟學家發表報告淡化了這一威脅,但美國銀行家協會質疑其依據。銀行界內部對技術的熟悉程度不同,導致其對穩定幣的看法不一。…

Ripple CEO Brad Garlinghouse 看好 CLARITY 法案通過

Ripple 執行長 Brad Garlinghouse 對於 CLARITY 法案的通過非常樂觀,表示銀行與加密代表間的爭執即將解決。 在全球經濟高峰會上,Garlinghouse 提到美國參議院正接近解決關於穩定幣收益的分歧。 美國財政部長要求國會迅速行動,以提供加密行業更清晰的監管規則。 參議員 Thom Tillis 將於本週恢復 CLARITY 法案的討論,解決銀行與加密業界的僵局。 預計 CLARITY…

Ripple 總裁對CLARITY法案態度轉變 — 樂觀度下降,但仍相信“已接近完成”

Ripple 總裁布拉德·加林豪斯(Brad Garlinghouse)對CLARITY法案的樂觀度減弱,但仍堅信法案即將面世。 在同時擔任爭論多時的CLARITY法案方面,加林豪斯重申美國急需明確的加密貨幣法規。 加林豪斯認為,即使市場因法規不明而挫折,這通常反而促成妥協,達成共識。 美國政治動能日增,參議員比爾·哈格蒂(Bill Hagerty)指4月可能有進展。 若法案通過,CLARITY法案將重新定位美國金融系統內的數位資產。 WEEX Crypto News, Garlinghouse 在CLARITY法案上的樂觀度有所消退 Ripple 總裁加林豪斯(Brad Garlinghouse)於2026年Semafor世界經濟高峰會上,對CLARITY法案的態度顯得謹慎。雖然法案的進展持續,但他的樂觀情緒已經有所減退。市場分析師戴安娜(Diana)指出,加林豪斯雖然軟化了他之前的樂觀態度,但對法案最終通過仍保持自信。加林豪斯重申,美國急需明確的加密法規,即使SEC和CFTC之間的共識增強,反而更顯示需要一個統一的框架,以明確定義數字資產的分類和市場中的監管方式,他的話中透露出深層的緊迫感:“當人們到達最高挫折時,便會妥協,我認為我們已經到達那個點。” 美國加密貨幣法規逐漸接近落實 過去,加林豪斯曾表達了對美國立法進程的樂觀,近期他提到,隨著華盛頓的政治動能增長,參議員比爾·哈格蒂(Bill…

加密清晰法案今年通過機會為30%,Wintermute的Hammond表示

Wintermute政策負責人Ron Hammond指出,加密清晰法案今年通過的機率僅30%,主要因政治磨擦和停滯的談判進程。 最大的障礙來自銀行,特別是在穩定幣收益問題上分歧明顯。 雖然立法進程充滿挑戰,但一些立法者仍推動法案在短期內獲得進展。 如果法案通過,將為市場機構創造一個更清晰的數位資產規範,促進加密資產的廣泛採用。 Wintermute正在擴大美國市場業務,使得加密清晰法案的結果尤為重要。 WEEX Crypto News, Apr 11, 2026 加密清晰法案的現況 羅漢蒙德(Ron Hammond),Wintermute的政策主管,對加密清晰法案通過的前景持謹慎態度,認為其在2026年通過的機率約為30%。這是因為儘管華盛頓出現推動法案的動力,政治磨擦和不穩定的談判進程始終阻礙法案的推進。清晰法案旨在為美國的加密市場結構設立規則,確定證券交易委員會和商品期貨交易委員會如何監管數位資產。 法案挑戰 銀行是法案通過的主要障礙。根據Hammond的說法,穩定幣是否應提供收益一直是傳統金融機構的爭議點。雖然經濟顧問委員會的報告對阻礙的銀行持反對立場,但談判未能取得進展,近期提出的一項“收益交易”方案也未能達成妥協,而新的方案則再次循環而來。 民主黨內部分歧…

前X產品負責人提出「構建某物」來應對加密貨幣低迷

X公司在四月份進行大規模機器人帳號清除,專注於加密貨幣相關垃圾信息。 比特幣週一回升至74,000美元,仍比年初低15%。 Nikita Bier表示可能發起「某項」計劃來解決加密貨幣市場困境。 X Money預計本月開放公眾試用,重塑平台為綜合金融及社交生態系統。 X平台加強打擊機器人賬號,但部分用戶報告合法內容受限。 WEEX Crypto News, 減少加密貨幣市場低迷中的失落感 X產品負責人Nikita Bier推測可能推出「某物」來解決加密貨幣市場低迷問題。比特幣本週一回升至74,000美元,儘管如此,仍較年初低15%。Bier於2026年4月14日暗示可能採取行動,但其具體內容仍未公佈,讓許多人猜測背後意圖。面對市場疲軟,平臺的策略或將改變。 X Money即將開放早期公眾訪問 X Money計劃在完成內部測試和外部測試後於本月開放早期訪問。該服務將涵蓋點對點轉賬、電子錢包及金融工具,類似於Venmo或PayPal。此舉意在推動X變成全功能應用,包括支付、卡片及帳戶管理功能。雖然尚未集成加密貨幣,但前任CEO Linda…

稀有代幣RAVE突飆6,000%,交易者困惑背後究竟為何

RAVE幣作為RaveDAO的原生代幣,短短一個月內暴漲超過6,000%,從約0.25美元上升至超過14美元,進入市值前50大加密貨幣。 RaveDAO定位為Web3音樂協議,結合EDM文化與區塊鏈技術,擁有鏈上票務、加密支付等功能,並宣稱已與Binance及OKX達成合作關係。 鏈上數據顯示,RAVE供應量的90%集中於三個錢包,超過98%在前十大錢包。這種高度集中和流動性稀薄的市場,促使空頭回補的風險上升。 一些觀察者認為此現象顯示市場的投機泡沫依然存在,令外界質疑數位資產市場是否回復健康。 WEEX Crypto News, RAVE飆升的原因 RAVE的快速崛起吸引了市場的激烈關注,背後的交易模式和流動性結構令人質疑其上升勢頭的可持續性。這個議題牽涉到代幣供應的分佈以及市場對該幣的短線交易狀況。 供應與集中 RAVE的一大特點是其代幣供應的極端集中化。資料顯示,RAVE總供應量的90%由三個主要錢包控制,這些錢包被認為與項目團隊有關。而在前十大錢包中,控制比例更高達98%。這樣的集中化使得市場流通的代幣極為稀少,進一步推高價格波動性。當交易所出現大量代幣轉移時,市場供需失衡便引發了價格劇烈波動。 市場動力與風險 在RAVE價格飆升之前,市場上空頭持倉過重,做空交易者大量湧入。在RAVE開始漲勢後,這些空頭被迫平倉,使得市場進一步推高價格。這樣的空頭擠壓,在加密貨幣市場並不少見,但充分暴露了投機風險和高波動性。 對市場的影響 這次飆升不僅僅是一個單一代幣的事件,這也反映了整個市場依然存在的脆弱性問題。由於其他代幣最近也被爆出安全漏洞和市場不當行為,RAVE的異常上漲加深了對市場不穩定的擔憂。一些分析師將此視為市場尚未回復健康的證據。 常見問題 RAVE是什麼? RAVE是RaveDAO的原生代幣,RaveDAO是一個將電子舞曲(EDM)文化與區塊鏈技術相結合的Web3音樂協議。…

清晰法案在參議院重新引入,可能影響XRP機構興趣

清晰法案重新引入美國參議院,旨在解決美國證券交易委員會(SEC)和商品期貨交易委員會(CFTC)之間的數位資產管轄權爭議。 該法案可能為XRP等代幣解鎖機構資金,但目前XRP在達到2.60美元的市場合約上,交易者的信心十分低。 XRP市場面值日交易量為$10,175美元,USDC實際成交價為$83美元,市場交易非常稀薄。 參議院銀行委員會的動作和Ripple CEO Brad Garlinghouse的公開評論可能會影響到市場預期。 小型交易來自大的監管消息可能會導致市場快速波動。 WEEX Crypto News, 清晰法案能否解決數位資產的管轄困局? 美國參議院重新引入的清晰法案旨在解決SEC和CFTC對數位資產管轄權的爭議。這可能為XRP和其他代幣解鎖更多的機構資金。然而,目前的市場反應仍然保留懷疑態度,合約上顯示,要達成XRP在4月底達到2.60美元,交易者的可能性看法僅為0.9%。 XRP市場狀況:交易面臨流動性挑戰 目前,XRP的市場日交易面值僅有$10,175美元,與USDC的實際交易價$83美元相比,顯得相當稀薄。這意味著,只需微小的交易量變動就能導致價格波動,而市場上任何具有實質影響的監管消息都可能引發大幅的價格變化。 機構投資者的潛在興趣 該法案經過參議院的路程對於XRP的未來至關重要,如果成功能為代幣解鎖長期缺乏的機構資本,這將大幅推動該加密貨幣的市場走向。現有數據顯示,市場對即時效果普遍不抱太大希望,因此,任何立法推進都可能迅速改變市場預期。 關注立法進程與市場反應…

RaveDAO (RAVE) 價格預測 2026,2027-2030

RaveDAO(RAVE)價格在過去24小時內激增199%,目前市場價格為$8.35。 2026年,RaveDAO預測價格攀升至$30.19840,但若市場情緒走低則可能下探至$0.98234。 若市場動能推動,RaveDAO(RAVE)有可能在未來達到新高。 預測2027至2030年,RAVE的價格分別為$55、$60、$65及$70。 WEEX Crypto News, RaveDAO (RAVE) 現行市場狀態 截至目前,RaveDAO(RAVE)的價格為$8.35。24小時內交易量高達$666.71M,市值為$2.06B。面對市場巨幅波動,其流通供應量達到248.03M RAVE,創下歷史新高$9.81(2026年4月13日)與歷史低點$0.1428(2025年12月12日)。 RaveDAO 是什麼? RaveDAO(RAVE)是一個結合區塊鏈技術與全球電子音樂的Web3項目,運行在以太坊網絡上。身為一個去中心化自治組織(DAO),讓社區成員共同參與決策與活動規劃。其使用RAVE代幣進行抵押、治理及參與獨家活動,使用NFTs作為票務工具,並藉由活動收入推動代幣回購與銷毀。 RaveDAO 2026價格預測 根據技術分析顯示,RaveDAO(RAVE)的市場目前呈現下降通道型態,暗示短期看空,但在突破上行趨勢線後可能轉為長期上升趨勢。技術指標表明,若突破上行通道,RAVE或可飆升至$39.67285,或若遭遇挫折則可能跌至$2.59977。…

法國部長:加密貨幣綁架事件後的新措施即將推出

法國正在採取行動以保護加密貨幣持有者免受於日益增長的綁架和扳手攻擊威脅。 今年初以來,法國已報告41起與加密貨幣相關的綁架事件,平均每2.5天就會發生一次。 2025年扳手攻擊增加了75%,其中法國成為此類事件的中心,共19起已確認事件。 巴黎區塊鏈週上宣佈了一個新的「預防平台」,吸引了成千上萬的註冊用戶。 法國政府面臨日益增長的壓力,需要採取更嚴格的行動。 WEEX Crypto News, 法國政府策劃新安全措施 法國政府正採取新措施,以應對不斷升級的加密貨幣綁架和扳手攻擊事件。巴黎區塊鏈週期間,內政部長代表讓-迪迪埃·伯傑宣布,他正在與內政部長勞倫·努涅斯合作制定更加嚴格的計劃,以保護加密貨幣持有者的安全。針對今年法國報告的41起與加密貨幣相關的綁架事件,政府感受到越來越大的壓力,需要立即行動。 扳手攻擊在法國迅速增多 今年,法國的加密貨幣綁架事件平均每2.5天就會發生一起,這使得法國成為全球扳手攻擊的中心。2025年全球扳手攻擊事件增加了75%,根據CertiK的數據,其中40%的事件發生在歐洲。法國在2025年報告了19起確認的扳手攻擊事件,成為此類事件中受影響最嚴重的國家之一。[插入圖片:顯示法國綁架事件的趨勢圖] 最近相關事件詳情 三月份,一對法國夫妻被冒充警察的罪犯搶劫,損失價值100萬美元的比特幣。法國警方已經加強了針對這種犯罪模式的打擊力度,並在二月份逮捕了六名涉嫌綁架地方法官和其母親的犯罪嫌疑人。這些事件凸顯了需要進一步加強保護行動的緊迫性。 增強的防範措施 加密貨幣的擁有者面臨的風險越來越多,讓-迪迪埃·伯傑提到了一個新的預防平台,該平台已吸引了成千上萬的用戶註冊。這是法國政府為保護公民免受此類犯罪行為的首次嘗試之一。更為嚴格的監控和社區合作或將成為新政策的一部分,以便更好地應對未來可能發生的威脅。[插入圖片:安全預防平台的截屏] 結論:法國的未來行動 作為全球加密貨幣市場的重要參與者,法國正努力確保持有者的安全。政府採取的行動將是如何應對越來越頻繁的扳手攻擊的指標。期待未來會有更為深入的方案出台,以保護加密貨幣投資者免於面臨潛在的威脅。…

加密巨頭 Kraken 的財技門道

當主動做市商開始主動出擊

匈牙利選舉震蕩:加密政策和監管或將重啟辯論

在2026年4月12日,彼得·馬加爾 (Péter Magyar)的親歐盟Tisza黨贏得壓倒性多數,結束了奧班16年的掌權,為打破匈牙利嚴苛的加密貨幣政策提供了可能。 政治上的改變已確認,但監管的逆轉尚未確定,這對交易者和運營者有深遠影響。 新政府若想撤銷現行措施,需要按序進行立法、監管和外交的三個機構行動。 歐盟的侵權程序是最可能快速解決匈牙利加密監管問題的途徑。 Tisza政黨的親歐立場可能加快與歐盟的和解進程,從而繞過全面的立法改革。 WEEX Crypto News, 匈牙利加密打壓背後的架構與選後改革需拆的障礙 匈牙利的加密打壓架構看似嚴厲,但實則更具針對性。從2025年7月1日起,新增了“加密濫用”和“未授權加密交易服務”兩項刑事罪,最高可處以2年監禁。這些措施主要針對大規模未經驗證的交易和未獲許可的平台,而不涉及比特幣持有或個人使用國際交易平台。 到2025年底,SARA許可證已成為實施交易所需的必要條件。這一狀況使得匈牙利成為以國家之力引導市場權力流向獲許可的本土運營商,而非國外的平台。像Revolut這樣的公司,因政策已完全禁止匈牙利用戶購買或存放加密貨幣。 任何政策逆轉需要先撤銷SARA驗證制度,然後修改或廢除刑事條款,最後還要與歐盟合作結束相關的違規程序。這三項並非一蹴而就,即便有新的政府提倡親歐政策,具體執行依然需要時間和多方協調。 [Place Image: SARA驗證流程示意圖] 歐盟對匈牙利監管架構影響…

新「數據資產」法規:為何AI代理可能移居馬恩島

馬恩島的Tynwald通過了2025年《基礎法(修正案)》,開創全球首例承認數據為法律資產的法規。 該法規為去中心化AI協議提供了所需的法律基礎,以數據作為合法資產運營。 新法框架解決了AI項目的數據治理、數據所有權及資金獲取三大核心問題。 在全球主要法域缺乏統一法律框架的狀態下,馬恩島提供了一個獨特的法律環境。 這一改變使得數據從無形資產轉變為可在財務報表中體現的有形資產。 WEEX Crypto News, 2025年《基礎法(修正案)》對DeAI營運者的實質變革 《基礎法(修正案)》創建了一個新的法律實體——數據資產基金會(DAF),該實體根據2011年《基礎法》架構,將數據視為其主要資產。這不僅填補了法律縫隙,還賦予去中心化AI協議更大的權利和可能性。 DeAI協定可以將訓練數據集存放在DAF內,並賦予數據正式的法律地位。此外,這種框架提供了可審計且可執行的數據治理規則,保障社群成員貢獻數據時的所有權與透明度,並提供了一個穩固的法律機制來處理數據資產交易。 相比英國、美國和歐盟的做法,馬恩島的制度為AI公司提供了更為清晰的法律路徑。英國擬在2023年引入數字資產的第三類財產類別,但尚未實施具體立法;美國則在不同領域內各成一體,缺乏統一的法律框架;而歐盟則專注於數據存取與可攜性,而非數據的資產化。 DAF的設立對數據治理的影響 DAF提供的不是簡單的法律地位,而是實現了數據治理的跨越式變革。它不僅改善了AI模型的數據來源合法性,還為資本市場進一步融入提供了穩固基礎。 數據策略負責人Aga Strandskov指出,缺乏可信賴的法律框架一直是使用數據的最大障礙,新法案正是解決了這個問題。而曼恩Benham的總經理Miles Benham則進一步提到,馬恩島傳統的博彩業將從此受益,因為它們昔日的數據資產終於可以得到法律承認。 如同日本將加密貨幣重新分類為金融工具一樣,馬恩島的法規將數據從模糊不清的狀態轉變為法律承認的資產,這無疑為數據的商業化提供了可行的基礎。…

川普加密貨幣巨鯨聚集:午餐會前的幕後動作

TRUMP 代幣價格約為 $2.80,持有超過一百萬代幣的錢包已增至 83 個。 4月25日在佛羅里達的 Mar-a-Lago,將舉行限量 297 名代幣持有者參加的加密午餐會。 大鯨錢包“8DHkza”從 Bybit 提取了超過 85 萬枚 TRUMP 代幣。 供應數據顯示,91% 的…

以太坊價格預測:黃金三角形將使ETH呈拋物線上升

以太坊價格目前在2200美元上下波動,預示着可能出現劇烈上升。 分析師指出一個黃金三角形結構,通過ETH的圖表預測未來將突破12,000美元。 2026年底,以太坊可能會觸及7500美元。 宏觀市場中存在恐慌情緒,恐懼與貪婪指數顯示深度恐懼。 以太坊的供應量正在減少,且機構資金流入增多。 WEEX Crypto News, 以太坊價格預測:2026年底有望突破7500美元 ETH目前的價格在2000至2200美元之間整合,最近跌至2000美元後的波動率為3.89%。分析指出,雖然市場恐慌情緒高漲,但賣方的勢頭逐漸減弱。技術指標顯示,如果能有效持守2090美元的移動平均線,未來有望回升至2400美元,並挑戰黃金三角形以突破7500美元的目標,甚至在2027年升至15,000美元。[Place Image: ETH價格走勢圖] 擁有早期優勢的比特幣超目標 目標價格定在7500美元的ETH需要從目前的價格實現3.5倍的增長。就一些市場上的早期投資機會而言,比特幣超目標型項目已經吸引了大量的預售資金。該項目宣稱可以在比特幣的安全層上引入Solana的虛擬機整合,增加智能合約的速度和拓展能力。抵達迅速的期望是基於它的核心理念,訴求解決比特幣交易速度慢、費用高和缺少編程能力的問題,而不損害比特幣的信任模式。在預售期間,該項目已籌集超過3200萬美元,並提供代幣抵押。[Place Image: 比特幣超目標項目的圖示] 問題解答 預測中的黃金三角形是什麼?…