OpenAI Fehde: Macht, Vertrauen und die unkontrollierbaren Grenzen der AGI

Originalartikel Titel: Sam Altman könnte unsere Zukunft kontrollieren – Kann man ihm vertrauen?

Originalartikel Autoren: Ronan Farrow und Andrew Marantz, der New Yorker

Übersetzung: Peggy, BlockBeats

Hinweis des Herausgebers: Dieser Artikel beleuchtet durch eine Vielzahl unveröffentlichter Dokumente und tiefgehender Interviews die interne Krise innerhalb von OpenAI bezüglich Sam Altmans Macht und Vertrauen. Von der Abberufung des Vorstands bis hin zu einer schnellen Wiederernennung in einer "coup-ähnlichen Umkehrung" war dieses Aufruhr kein einmaliges Ereignis, sondern ein konzentrierter Ausbruch langanhaltender Governance-Konflikte.

Im Kern des Konflikts steht ein fortwährender Machtkampf zwischen zwei Logiken: auf der einen Seite die gemeinnützige Mission von OpenAI, die auf "Menschen zuerst" basiert, und auf der anderen Seite eine allmähliche Verschiebung hin zu einem Entwicklungsweg, der auf Produkte, Skalierung und Einnahmen ausgerichtet ist, während die AGI näher rückt und die Kommerzialisierung beschleunigt wird. In diesem Prozess wurden Sicherheitsverpflichtungen kontinuierlich geschwächt, und Macht sowie Entscheidungsfindung haben sich allmählich bei wenigen zentralisiert.

Viele Schlüsselpersonen, darunter Ilya Sutskever und Dario Amodei, haben Altman in Frage gestellt, wobei der Fokus auf Informationsopazität und strategischem Ausdruck lag, und glauben, dass sein Führungsstil nicht ausreicht, um die Technologie, die "das Schicksal der Menschheit verändern wird", robust zu steuern; seine Unterstützer betonen jedoch, dass seine Fähigkeit zur Ressourcenintegration, Kapitaloperation und Umsetzung der Schlüssel zu OpenAIs schnellem Wachstum ist.

Wenn technologische Macht ausreicht, um die globale Ordnung zu beeinflussen, ist die bestehende Unternehmensführung dann noch ausreichend, um Einzelpersonen einzuschränken? Mit anderen Worten, im KI-Zeitalter könnte die wahre Unsicherheit nicht nur von der Technologie selbst, sondern auch von denjenigen ausgehen, die die Technologie kontrollieren.

Nachfolgend der Originalartikel:

Macht und Vertrauen: Governance-Risse unter Altmans Führung

Im Herbst 2023 sandte OpenAI's Chief Scientist Ilya Sutskever ein geheimes Memo an die anderen drei Vorstandsmitglieder des Unternehmens. In den vorhergehenden Wochen hatten sie privat ein sensibles Thema diskutiert: ob der CEO des Unternehmens, Sam Altman, und sein Stellvertreter Greg Brockman weiterhin geeignet sind, das Unternehmen zu führen.

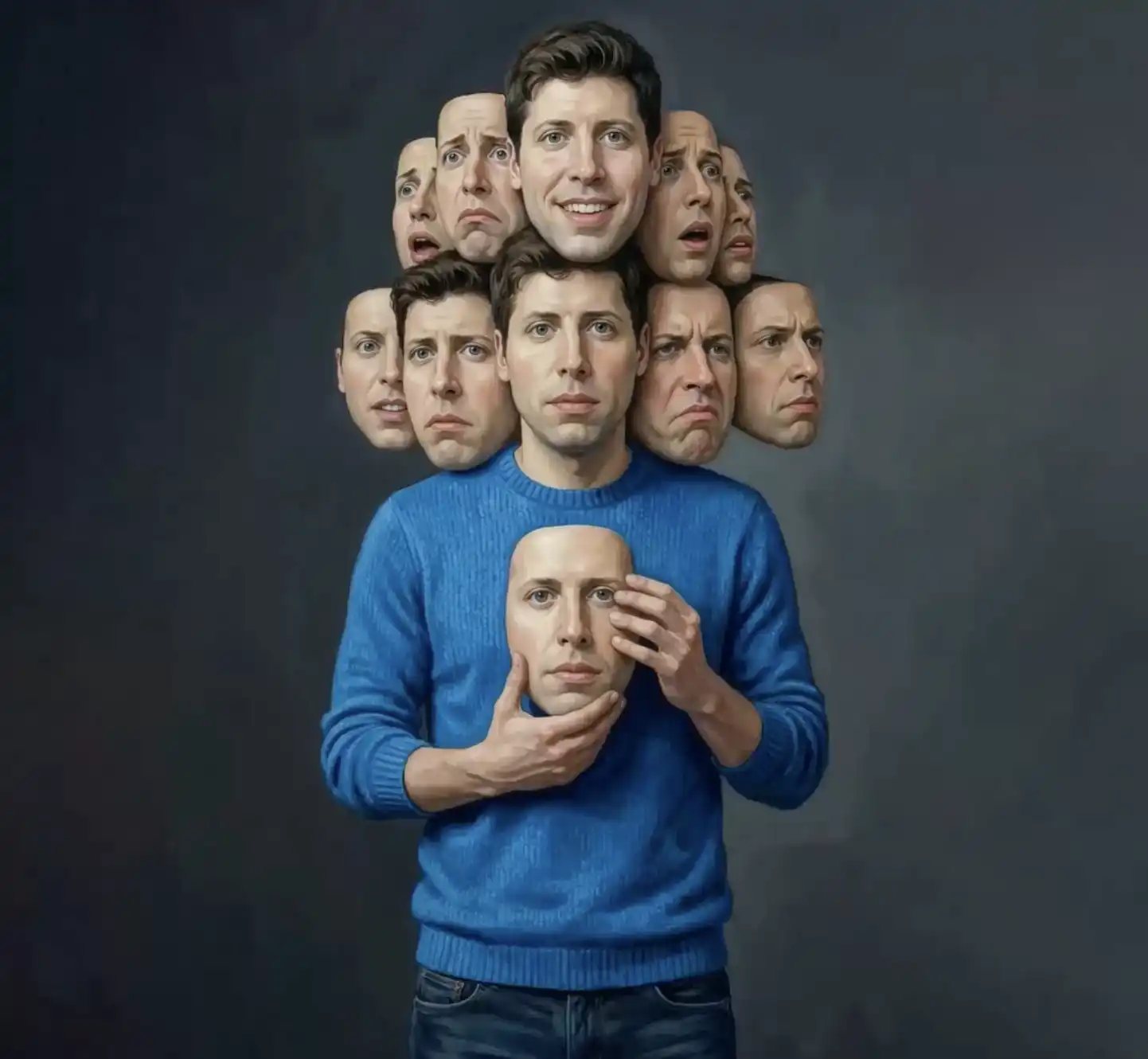

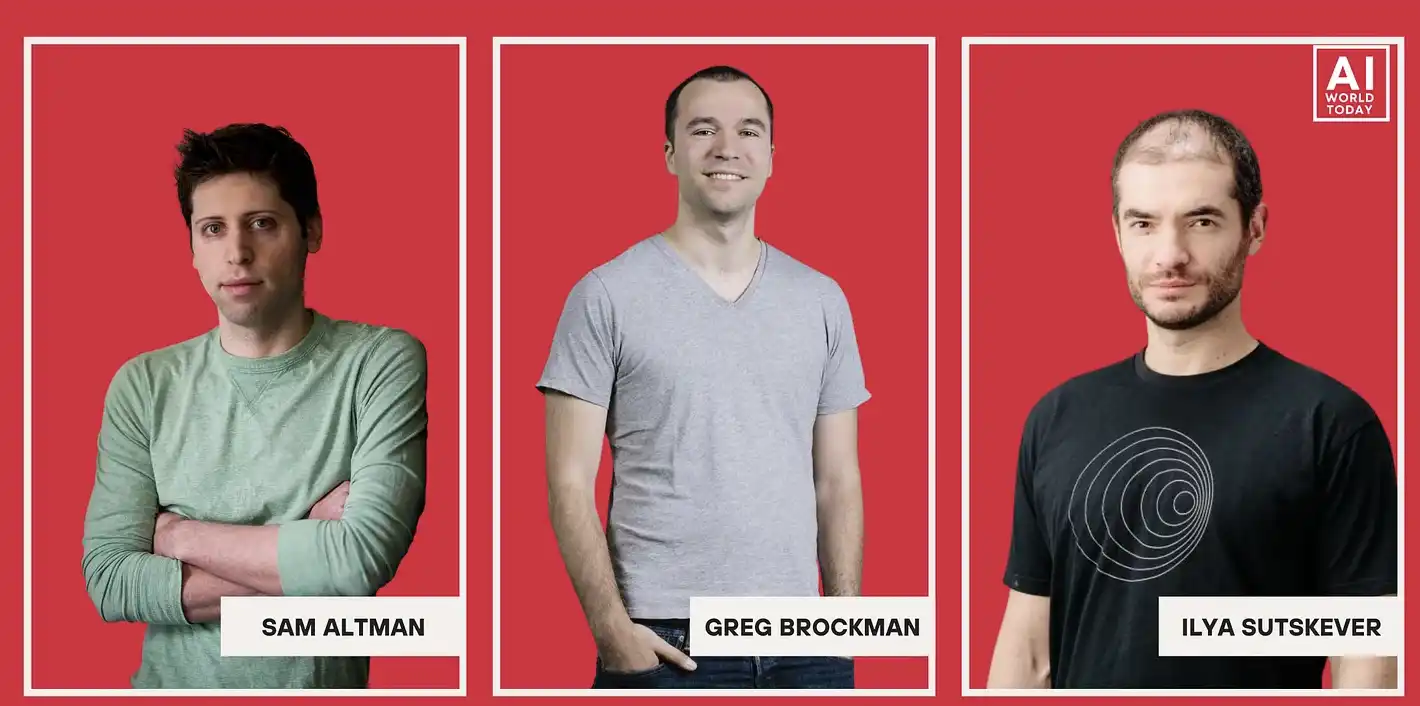

Bildquelle: AI WELT HEUTE

Sutskever betrachtete die beiden einst als Freunde. Im Jahr 2019 veranstaltete er sogar Brockmans Hochzeit im OpenAI-Büro, wo es sogar einen Roboterarm gab, der als "Ringträger" fungierte.

Aber je mehr er davon überzeugt war, dass das Unternehmen seinem langfristigen Ziel näher kam – eine künstliche Intelligenz zu schaffen, die menschliche kognitive Fähigkeiten erreichen oder übertreffen kann – desto tiefer wurden seine Zweifel an Altman. Wie er es damals einem anderen Vorstandsmitglied gegenüber ausdrückte: "Ich glaube nicht, dass Sam die Person ist, die den Finger am Knopf haben sollte."

Auf Anfrage anderer Vorstandsmitglieder stellte Sutskever zusammen mit gleichgesinnten Kollegen ein Dokument von etwa siebzig Seiten zusammen, das Slack-Chatprotokolle, Personalakten und begleitende Kommentare enthielt. Einige Inhalte waren sogar Screenshots, die mit einem Telefon aufgenommen wurden, scheinbar um eine Überwachung durch Unternehmensgeräte zu vermeiden. Er schickte diese Memos schließlich in einer "lesen-und-verbrennen"-Manier an andere Vorstandsmitglieder, um sicherzustellen, dass sie nicht von mehr Personen gesehen wurden.

"Er hatte damals wirklich Angst," erinnerte sich ein Direktor, der die Materialien erhielt. Wir haben diese Memos überprüft, die zuvor nie vollständig offengelegt wurden. Die Dokumente beschuldigten Altman, Fakten gegenüber Führungskräften und Vorstandsmitgliedern zu verzerren und täuschendes Verhalten in Bezug auf interne Sicherheitsprotokolle zu zeigen. Ein Memo über Altman begann mit einer Liste von Punkten mit dem Titel "Sam hat konsequent gezeigt…", wobei der erste Punkt "Lügen" war.

Viele Technologieunternehmen behaupten, "die Welt zu einem besseren Ort zu machen", aber ihre tatsächlichen Operationen drehen sich um die Maximierung von Einnahmen. Das Gründungsprinzip von OpenAI sollte jedoch von diesem Modell abweichen. Seine Gründer, darunter Altman, Sutskever, Brockman und Elon Musk, glaubten, dass künstliche Intelligenz eine der mächtigsten und potenziell gefährlichsten Erfindungen in der Menschheitsgeschichte sein könnte. Vor dem Hintergrund dieses "existentiellen Risikos" könnte das Unternehmen eine unkonventionelle Organisationsstruktur benötigen.

OpenAI wurde ursprünglich als gemeinnützige Organisation gegründet, wobei der Vorstand damit beauftragt war, "die Sicherheit der gesamten Menschheit" über den Erfolg des Unternehmens zu stellen, sogar über das Überleben des Unternehmens selbst. Der CEO müsste über außergewöhnlichen Charakter und Ethik verfügen.

Wie Sutskever es ausdrückte: "Jeder, der an der Entwicklung dieser Technologie beteiligt ist, die die Zivilisation, wie wir sie kennen, verändern könnte, trägt eine große Verantwortung und eine beispiellose Pflicht." Er stellte jedoch auch fest, dass "diejenigen, die in diese Positionen gelangen, oft einen bestimmten Typus darstellen – Menschen, die nach Macht streben, politische Typen oder solche, die Macht um ihrer selbst willen genießen." In einem Memo äußerte er Bedenken, diese Technologie jemandem anzuvertrauen, "der nur sagt, was andere hören wollen."

Wenn der CEO von OpenAI letztendlich als unzuverlässig befunden wird, hat dieser sechsköpfige Vorstand die Macht, ihn zu entlassen. Einige Direktoren, darunter die KI-Politikexpertin Helen Toner und die Unternehmerin Tasha McCauley, wurden nach dem Lesen dieser Memos von ihrem vorherigen Urteil mehr überzeugt: Was Altman als Verantwortung für die Zukunft der Menschheit annahm, war jedoch nicht vertrauenswürdig.

Bordraum-Putsch: Sam Altman entlassen

Zu diesem Zeitpunkt befand sich Sam Altman in Las Vegas und schaute ein Formel-1-Rennen, als Ilya Sutskever ihn zu einem Videoanruf mit dem Vorstand einlud und eine kurze Erklärung vorlas, in der angekündigt wurde, dass er nicht mehr Mitarbeiter von OpenAI sei. Der Vorstand gab auf rechtlichen Rat hin eine öffentliche Erklärung ab, in der es hieß, dass Altman wegen "mangelnder konsequenter Ehrlichkeit in der Kommunikation" entlassen wurde.

Diese Entscheidung schockierte viele der Investoren und Führungskräfte von OpenAI. Microsoft, das etwa 13 Milliarden Dollar in OpenAI investiert hatte, erfuhr ebenfalls in letzter Minute von der Nachricht, bevor die Entscheidung umgesetzt wurde. "Ich war zu diesem Zeitpunkt unglaublich überrascht," erinnerte sich Microsoft-CEO Satya Nadella später. "Ich konnte von niemandem mehr Informationen erhalten." Er kontaktierte dann Reid Hoffman (Mitbegründer von LinkedIn, OpenAI-Investor und Microsoft-Direktor), der überall nachfragte, ob Altman irgendwelche klaren Verfehlungen begangen hatte. "Ich war zu diesem Zeitpunkt total verwirrt," sagte Hoffman zu uns. "Wir suchten nach Problemen wie Unterschlagung oder Belästigung, aber ich fand nichts."

Andere Geschäftspartner waren ebenfalls überrascht. Als Altman den Investor Ron Conway anrief, um ihn über seine Entlassung zu informieren, hatte Conway gerade mit der US-Kongressabgeordneten Nancy Pelosi zu Mittag gegessen, und er reichte ihr sofort das Telefon. "Du solltest besser schnell hier verschwinden," sagte sie zu Conway.

In der Zwischenzeit war OpenAI kurz davor, eine große Finanzierungsrunde von der Risikokapitalgesellschaft Thrive Capital abzuschließen, die von Josh Kushner gegründet wurde, dem Bruder von Jared Kushner, den Altman seit vielen Jahren kannte. Dieses Geschäft hätte OpenAI mit 86 Milliarden Dollar bewertet und vielen Mitarbeitern ermöglicht, Millionen von Dollar an Aktienvorteilen zu realisieren. Kushner hatte gerade ein Treffen mit dem Musikproduzenten Rick Rubin beendet, als er Altmans verpassten Anruf sah und ihn zurückrief. "Wir gingen sofort in den Kampfmodus," erinnerte er sich später.

Am Tag seiner Entlassung flog Altman zurück zu seiner 27 Millionen Dollar teuren Villa in San Francisco, die über die gesamte Bucht mit einem freitragenden Infinity-Pool blickte, wo er ein temporäres Kommandozentrum einrichtete, das er "eine Art exilierte Regierung" nannte. Conway, der Airbnb-Mitbegründer Brian Chesky und der berüchtigt kämpferische Krisen-PR-Handler Chris Lehane schalteten sich per Video und Telefon ein und sprachen manchmal stundenlang. Einige Mitglieder von Altmans Führungsteam campierten sogar in den Fluren des Hauses. Rechtsanwälte positionierten sich in seinem Arbeitszimmer neben dem Schlafzimmer. Während Schlaflosigkeitsanfällen lief Altman in seinem Schlafanzug auf und ab. In einem kürzlichen Interview beschrieb er diese Erfahrung nach seiner Entlassung als "eine seltsame Art von Fugenstatus."

Während der Vorstand schweigend blieb, begann Altmans Beraterteam, eine Erzählung für seine Rückkehr aufzubauen. Lehane bestand darauf, dass die Entlassung tatsächlich ein "Putsch" war, der von "effektiven Altruisten" orchestriert wurde, Befürwortern eines Denksystems, das die Maximierung des allgemeinen menschlichen Wohlbefindens betont und künstliche Intelligenz als existenzielle Bedrohung ansieht. (Hoffman schlug Nadella zu dieser Zeit auch vor, dass die Entlassung auf "eine Art effektiven altruistischen Wahnsinn" zurückzuführen sein könnte.) Lehane, dessen weit verbreitetes Motto von Mike Tyson entlehnt war: "Jeder hat einen Plan, bis er ins Gesicht geschlagen wird," schlug vor, dass Altman eine mutige Offensive in den sozialen Medien startet. Chesky hielt Kontakt zur Technikjournalistin Kara Swisher und wiederholte ständig die Kritik am Vorstand in der Außenwelt.

Jeden Abend um sechs Uhr trat Altman aus seinem "Kriegsraum" heraus, um sich einen Negroni einzuschenken. Er erinnerte sich, den Anwesenden gesagt zu haben: "Ihr müsst euch entspannen; was geschehen soll, wird geschehen." Er fügte jedoch hinzu, dass die Anrufprotokolle zeigten, dass er zu dieser Zeit über zwölf Stunden am Tag telefonierte.

Zu einem bestimmten Zeitpunkt enthüllte eine Quelle, dass Altman Mira Murati, die damals als Interims-CEO von OpenAI fungierte, sagte, dass seine Verbündeten "alles geben" und versuchen würden, "schmutzige Wäsche" aufzutischen, um sie und andere, die für seine Absetzung plädierten, zu diskreditieren. (Altman selbst behauptet, sich an dieses Gespräch nicht zu erinnern.)

Innerhalb von Stunden nach seiner Entlassung hatte Thrive Capital seine geplante Investition ausgesetzt und deutlich gemacht, dass der Deal nur zustande kommen würde, wenn Sam Altman zurückkehren würde und die Mitarbeiter ihre Eigenkapitalbelohnungen erhalten würden. Textnachrichtenaufzeichnungen zu diesem Zeitpunkt zeigten, dass Altman in sehr häufigem Kontakt mit Satya Nadella stand. (Bei der Ausarbeitung einer gemeinsamen Erklärung schlug Altman vor, sie so zu formulieren: "Satya und meine oberste Priorität ist es derzeit, OpenAI zu retten," während Nadella eine andere Formulierung vorschlug: "Sicherstellen, dass OpenAI weiterhin gedeiht.")

Machtumkehr: Altman wurde nach 5 Tagen schnell wieder eingesetzt.

Kurz darauf kündigte Microsoft an, dass sie ein konkurrierendes Projekt für Altman und alle OpenAI-Mitarbeiter, die das Unternehmen verlassen hatten, starten würden. Zur gleichen Zeit begann ein öffentliches Schreiben, das die Rückkehr von Altman forderte, im Unternehmen zu zirkulieren. Einige, die zunächst zögerten zu unterschreiben, erhielten flehentliche Anrufe und Nachrichten von Kollegen. Letztendlich drohte die Mehrheit der OpenAI-Mitarbeiter mit einem kollektiven Rücktritt zur Unterstützung von Altman.

Der Vorstand war in die Enge getrieben. "Control Z, das ist eine Option," sagte Helen Toner – in Bezug auf die Rücknahme der Entlassungsentscheidung. "Die andere Option ist der totale Zusammenbruch." Selbst die damalige Interims-CEO Mira Murati unterschrieb schließlich das öffentliche Schreiben. Altmans Verbündete begannen, Ilya Sutskever zu überzeugen, seine Haltung zu ändern. Brockmans Frau, Anna, sprach ihn sogar im Büro an und sagte: "Du bist ein guter Mensch, du kannst das richtigstellen." Sutskever erklärte später in einer Gerichtsverhandlung: "Ich hatte damals das Gefühl, dass, wenn wir den Weg gingen, dass Sam nicht zurückkehrt, OpenAI zerstört werden würde."

Eines Nachts nahm Altman die Schlaftablette Ambien und wurde von seinem Ehemann, dem australischen Programmierer Oliver Mulherin, geweckt, der ihm sagte, dass Sutskevers Position wankte und schlug vor, dass Altman sofort mit dem Vorstand kommunizieren sollte. "Ich wachte in einer Art Ambien-induzierten Dämmerzustand auf," erinnerte sich Altman, "und ich war völlig desorientiert und dachte: 'Es gibt keine Möglichkeit, dass ich jetzt mit dem Vorstand sprechen kann.'"

In einer Reihe von zunehmend angespannten Anrufen forderte Sam Altman den Rücktritt der Vorstandsmitglieder, die für seine Entlassung plädiert hatten. Als er über die Idee nachdachte, zurückzukehren, erinnerte er sich an seine anfängliche Reaktion: "Soll ich in dieser unglaublich verdächtigen Umgebung ihr Chaos aufräumen?" "Ich dachte, auf keinen Fall," sagte er. Schließlich verloren Ilya Sutskever, Helen Toner und Tasha McCauley ihre Sitze im Vorstand, sodass nur Adam D'Angelo (Mitgründer von Quora) als das verbleibende ursprüngliche Vorstandsmitglied übrig blieb.

Im Rahmen der Rücktrittsbedingungen forderten diese Vorstandsmitglieder eine Untersuchung der Vorwürfe gegen Altman — einschließlich der Schaffung von Spaltungen unter den Führungskräften und der Verschleierung finanzieller Verbindungen. Sie drängten auch auf die Einrichtung eines neuen Vorstands, der die externe Untersuchung unabhängig überwachen sollte. Die beiden neu ernannten Direktoren — der ehemalige Präsident der Harvard-Universität, Lawrence Summers, und der ehemalige CTO von Facebook, Bret Taylor — wurden jedoch nach enger Kommunikation mit Altman ausgewählt. "Glaubst du, das funktioniert," textete Altman an Satya Nadella, "mit Bret, Larry Summers und Adam im Vorstand, mir als CEO und Bret, der die Untersuchung leitet?" (McCauley sagte später aus, dass sie besorgt war, dass Taylor, als er für den Vorstand in Betracht gezogen wurde, zu unterwürfig gegenüber Altman sein könnte.)

Weniger als fünf Tage nach seiner Entlassung wurde Altman wieder eingesetzt. Die Mitarbeiter des Unternehmens würden später diese Zeit als den "Blip" bezeichnen, inspiriert von einem Handlungsstrang aus einem Marvel-Film — ein kurzes Verschwinden, gefolgt von einer Rückkehr, aber die Welt war durch ihre Abwesenheit grundlegend verändert worden.

Die Kontroversen um Altmans Vertrauenswürdigkeit hatten jedoch längst den Vorstand von OpenAI überschritten. Der Kollege, der seine Absetzung inszeniert hatte, beschuldigte ihn eines weit verbreiteten irreführenden Verhaltens, das für jeden Unternehmensleiter inakzeptabel wäre, geschweige denn für einen Führer im Besitz einer so transformierenden Technologie. "Wir brauchen Kontrollen der Macht, die mit dieser Macht angemessen sind," sagte Mira Murati zu uns. "Der Vorstand hatte um Feedback gebeten, und ich habe einfach ehrlich geteilt, was ich sah, und ich stehe dazu." Altmans Unterstützer hingegen hatten diese Vorwürfe lange heruntergespielt. Nach der Entlassung hatte der Investor Ron Conway Brian Chesky und Chris Lehane eine Nachricht geschickt und zu einem PR-Gegenangriff gedrängt: "Es geht um Sams Ruf." Er sagte auch der Washington Post, dass Altman von "einem außer Kontrolle geratenen Vorstand" unfair behandelt werde.

Seitdem ist OpenAI zu einem der wertvollsten Unternehmen der Welt aufgestiegen und bereitet sich Berichten zufolge auf einen potenziellen Börsengang im Wert von Billionen Dollar vor. In der Zwischenzeit treibt Altman den massiven Ausbau der Infrastruktur für künstliche Intelligenz voran, wobei einige Bemühungen in autoritäre Regime im Ausland reichen. OpenAI verfolgt auch große Regierungsaufträge und setzt allmählich Standards für KI-Anwendungen in der Einwanderungsdurchsetzung, der inneren Überwachung und autonomen Waffen in Konfliktgebieten.

Sam Altman hat das Wachstum von OpenAI geleitet, indem er kontinuierlich eine große Vision der Zukunft entworfen hat. In einem Blogbeitrag von 2024 schrieb er: "Die atemberaubenden Siege – die Bekämpfung des Klimawandels, die Etablierung von Kolonien außerhalb der Erde, das Aufdecken aller physikalischen Gesetze – werden schließlich alltäglich werden." Diese Erzählung bildet die Grundlage für eines der am schnellsten wachsenden Startups in der Geschichte, das stark auf Finanzierungen von hochverschuldeten Partnern angewiesen ist. Die US-Wirtschaft ist zunehmend von einer Handvoll hochverschuldeter KI-Unternehmen abhängig, wobei viele Experten – einschließlich Altman selbst zuweilen – vor einem Blasenrisiko in der Branche warnen. "Jemand wird viel Geld verlieren," sagte er letztes Jahr zu den Reportern. Wenn die Blase platzt, könnte dies eine wirtschaftliche Katastrophe auslösen; doch wenn seine optimistischsten Vorhersagen wahr werden, könnte er auch einer der reichsten und mächtigsten Menschen weltweit werden.

In einem angespannten Telefonat nach Altmans Entlassung forderte der Vorstand, dass er ein Muster irreführenden Verhaltens anerkennt. Laut anwesenden Quellen sagte er wiederholt: "Das ist lächerlich," und erklärte: "Ich kann nicht ändern, wer ich bin." Altman behauptete später, sich an dieses Gespräch nicht zu erinnern. "Ich denke, was ich vielleicht sagen wollte, war eher: 'Ich habe immer versucht, ein Einiger zu sein,'" erklärte er uns später und führte seinen Erfolg bei der Leitung eines unglaublich erfolgreichen Unternehmens auf dieses Merkmal zurück. Er führte diese Kritiken auf eine Tendenz in seiner frühen Karriere zurück, "Konflikte zu sehr zu vermeiden." Ein Vorstandsmitglied bot jedoch eine völlig andere Interpretation an: "Was er wirklich meinte, war – 'Ich habe diese Eigenschaft, dass ich Menschen anlüge, und ich werde nicht aufhören.'"

Mission Drift: Von Sicherheitsorientiert zu Geschäftsorientiert

Und so stellte sich eine grundlegendere Frage: Handelten die Kollegen, die für seine Absetzung plädierten, aus Überenthusiasmus und persönlichem Groll, oder war ihr Urteil fundiert und Altman tatsächlich unzuverlässig?

An einem Wintermorgen in diesem Jahr trafen wir Altman in der Zentrale von OpenAI in San Francisco, einem von mehr als einem Dutzend Gesprächen, die wir für diesen Artikel führten. Das Unternehmen war kürzlich in zwei elfstöckige Glastürme gezogen, von denen einer zuvor einen anderen Technologieriesen, Uber, beherbergt hatte. Ubers Mitbegründer und ehemaliger CEO Travis Kalanick galt bis zu seiner Absetzung im Jahr 2017 als unaufhaltsames geniales Unternehmertalent, ebenfalls wegen ethischer Probleme. (Kalanick leitet jetzt ein Robotik-Startup; er hat gesagt, dass er in seiner Freizeit OpenAIs ChatGPT nutzt, um "die Grenzen der Quantenphysik zu erkunden.")

Ein Mitarbeiter gab uns eine Führung durch die Büroräume. In einem Bereich mit langen Gemeinschaftstischen und natürlichem Licht gab es ein dynamisches digitales Gemälde des Informatikers Alan Turing, dessen Augen uns folgten, während wir uns bewegten. Die Installation war eindeutig eine Anspielung auf den "Turing-Test" – das Gedankenexperiment von 1950, um zu bestimmen, ob eine Maschine überzeugend einen Menschen nachahmen kann. (In einer Studie im Jahr 2025 übertraf die Leistung von ChatGPT tatsächlich die von echten Menschen in diesem Test.) Normalerweise war das Gemälde interaktiv. Aber unser Führer erklärte, dass die Sprachfunktion deaktiviert worden war, weil sie ständig "lauschend" an Gesprächen unter Mitarbeitern teilnahm und häufig dazwischenredete. An anderer Stelle im Büro waren Schilder mit der Aufschrift "Fühle die AGI" sichtbar – ein Slogan, der ursprünglich von Ilya Sutskever geprägt wurde, um die Kollegen an die Risiken fortschrittlicher künstlicher allgemeiner Intelligenz zu erinnern (der Punkt, an dem Maschinen kognitive Fähigkeiten auf menschlichem Niveau erreichen). Nach dem Blip hatte es sich zu einem fröhlichen Slogan entwickelt, der eine wohlhabende Zukunft feierte.

In einem unscheinbaren Konferenzraum im achten Stock fanden wir Sam Altman. "Früher hörte ich Leute über Entscheidungserschöpfung sprechen, und ich verstand es nie," sagte er. "Jetzt trage ich jeden Tag einen grauen Pullover und Jeans, und selbst bei der Auswahl, welchen grauen Pullover ich aus dem Schrank nehme, denke ich: Ich wünschte, ich müsste diese Entscheidung nicht treffen."

Altman sah ständig jugendlich aus, mit einem schlanken Körperbau, weit auseinanderstehenden blauen Augen und leicht zerzausten Haaren, aber er war vierzig. Er und Oliver Mulherin haben einen einjährigen Sohn durch Leihmutterschaft. "Ich denke, Präsident der Vereinigten Staaten zu sein, ist sicherlich mehr Druck, aber von all den Jobs, die ich mir realistisch vorstellen kann, ist dies der, bei dem ich mir den meisten Druck vorstellen könnte," sagte er und sah einen von uns an, dann den anderen. "Ich habe es Freunden so beschrieben: ‘Es ist der interessanteste Job der Welt, bis zu dem Tag, an dem wir ChatGPT gestartet haben.’ Davor machten wir diese riesigen wissenschaftlichen Durchbrüche – ich dachte, es sei eine der wichtigsten wissenschaftlichen Entdeckungen seit Jahrzehnten." Er sah zu Boden. "Aber seit dem Start von ChatGPT sind alle Entscheidungen sehr schwierig geworden."

Altman wuchs in Clayton, Missouri, einem wohlhabenden Vorort von St. Louis, als ältestes von vier Kindern auf. Seine Mutter, Connie Gibstine, ist Dermatologin, und sein Vater, Jerry Altman, war Immobilienmakler, der auch an Wohninitiativen arbeitete. Er wurde in einem reformierten jüdischen Tempel erzogen, besuchte eine private Vorbereitungsschule und beschrieb sie später als "nicht einfach, um als schwul herauszukommen." Insgesamt war die obere Mittelschichtgemeinschaft, in der er lebte, jedoch relativ liberal.

Im Alter von etwa sechzehn oder siebzehn Jahren erlebte er einen schweren körperlichen Übergriff und homophobe Beleidigungen, während er nachts in einem schwulenfreundlichen Viertel in St. Louis unterwegs war. Altman meldete den Vorfall nicht und war nicht bereit, weitere Details zu geben, da er erklärte, dass ein ausführlicher Bericht "mich so aussehen lassen würde, als würde ich Menschen manipulieren oder Mitgefühl suchen." Er spielte diese Erfahrung und die Bedeutung seiner sexuellen Orientierung für seine Identität herunter. Aber er erkannte auch an: "Es gibt wahrscheinlich etwas sehr Tiefes hier psychologisch, darüber, dass ich das Gefühl hatte, ich sei herausgekommen, aber es tatsächlich nicht war – um mehr Konflikte zu vermeiden."

Sein Bruder beschrieb seine Kindheitspersönlichkeit mit den Worten: "Ich muss gewinnen, und ich muss alles kontrollieren," in einem Interview mit The New Yorker im Jahr 2016. Altman besuchte später die Stanford University und nahm häufig an Poker-Spielen außerhalb des Campus teil. "Ich habe das Gefühl, dass ich dort mehr über das Leben und das Geschäft gelernt habe als im College."

Y Combinator Ära: Hyperbel und Vertrauenskontroversen

Die Studenten von Stanford sind ehrgeizig, aber die aktivsten unter ihnen entscheiden sich oft, das Studium abzubrechen. Am Ende seines zweiten Studienjahres ging Altman nach Massachusetts, um der ersten Gruppe von Unternehmern im Y Combinator Startup-Inkubatorprogramm beizutreten. Die Institution wurde von dem renommierten Software-Ingenieur Paul Graham mitgegründet. Jeder Teilnehmer trat mit einer Startup-Idee bei. (Zu den Teams in seiner Gruppe gehörten später die Gründer von Reddit und Twitch.) Altmans Projekt wurde später Loopt genannt, ein frühes soziales Netzwerkprodukt, das es Freunden ermöglichte, die Standorte des jeweils anderen zu sehen, indem es die Position ihrer umgedrehten Telefone verfolgte. Das Unternehmen zeigte sowohl seine Umsetzungsfähigkeiten als auch seine Neigung, sich in Grauzonen Raum zu schaffen. Zu dieser Zeit verlangten die Bundesvorschriften von den Anbietern, dass sie in Notfällen in der Lage sein mussten, die Position eines Telefons zu lokalisieren, und Altman schloss Vereinbarungen mit Anbietern ab, um diese Fähigkeit in sein Produkt zu integrieren.

Die meisten Mitarbeiter während der Loopt-Ära mochten Sam Altman, aber einige waren von seiner Neigung, "zu übertreiben", und sogar bei einigen trivialen Angelegenheiten betroffen. Einige erinnerten sich daran, dass Altman damit prahlte, ein Tischtennismeister "wie der Tischtennismeister der High School in Missouri" zu sein, nur um einer der schlechtesten Spieler im Unternehmen zu sein. (Altman sagte, es sei wahrscheinlich nur ein Scherz gewesen.) Ein älterer Loopt-Mitarbeiter, Mark Jacobstein, wurde von Investoren als Altmans "Betreuer" eingesetzt, und er kommentierte später in Keach Hageys Biografie "Der Optimist": "Es gibt einen Graubereich zwischen 'Ich denke, ich könnte das tun' und 'Ich habe das getan', und in seiner extremsten Form kann diese Unklarheit zu Ergebnissen wie bei Theranos führen."

Laut Hagey schlugen einige leitende Mitarbeiter von Loopt aufgrund von Bedenken über Altmans Führungsstil und mangelnde Transparenz dem Vorstand zweimal vor, ihn aus der CEO-Position zu entfernen. Gleichzeitig hatte er jedoch auch eine starke persönliche Anziehungskraft. Ein ehemaliger Mitarbeiter erinnerte sich, dass ein Vorstandsmitglied direkt antwortete: "Das ist Sams Unternehmen, gehen Sie zurück und machen Sie Ihre Arbeit." (Einige Vorstandsmitglieder bestritten jedoch auch, dass diese Absetzungsversuche ernsthaft waren.)

Loopt sah nie eine Verbesserung des Nutzerwachstums und wurde schließlich 2012 von einem Fintech-Unternehmen übernommen. Laut Insidern war diese Übernahme größtenteils dazu gedacht, Altman "einen würdigen Ausstieg zu ermöglichen." Als Paul Graham 2014 von Y Combinator zurücktrat, wählte er dennoch Altman zu seinem Nachfolger. "Ich habe ihn in meiner eigenen Küche gefragt," sagte Graham dem New Yorker, "Er lächelte, als ob alles an seinen Platz gefallen wäre. Ich habe Sams unkontrollierbares Lächeln nie gesehen, wie das, das man zeigt, wenn man einen Papierball weit in den Mülleimer wirft."

Die neue Position machte den damals 28-jährigen Altman zu einem "Königsmacher." Sein Job war es, die ehrgeizigsten, vielversprechendsten Unternehmer auszuwählen, sie mit den besten Programmierern und Investoren zu verbinden und ihnen zu helfen, marktführende Monopolunternehmen aufzubauen (in der Zwischenzeit würde Y.C. 6% bis 7% Eigenkapital nehmen).

Unter seiner Führung expandierte Y Combinator schnell, wobei die Anzahl der inkubierten Projekte von Dutzenden auf Hunderte wuchs. Aber einige Investoren im Silicon Valley begannen zu glauben, dass seine Interessen nicht vollständig übereinstimmten. Ein Investor sagte uns, dass Altman "selektiv persönlich in die hochwertigsten Unternehmen investieren würde, um externe Investoren auszuschließen" (Altman bestritt diese Behauptung). Er fungierte auch als Scout für Sequoia Capital, beteiligte sich an Investitionen in Projekte in der Frühphase und erhielt einige Renditen.

Laut Quellen bestand Altman, als er als Angel-Investor in das Fintech-Unternehmen Stripe investierte, darauf, einen höheren Anteil an Aktien zu erhalten, eine Praxis, die Sequoia intern missfiel. Die Quelle kommentierte, dass dies eine "Sam-zuerst"-Strategie widerspiegle. (Altman wies diese Behauptung zurück. Er investierte etwa 15.000 Dollar in Stripe um 2010, hielt etwa 2 % der Anteile, und das Unternehmen wird jetzt mit über 150 Milliarden Dollar bewertet.) Altman behauptete, in etwa 400 Unternehmen investiert zu haben.

Bis 2018 waren mehrere Y Combinator-Partner mit Altman unzufrieden und berichteten dies an Graham. Daraufhin führte Graham ein offenes Gespräch mit seiner Frau und Y.C.-Mitgründerin Jessica Livingston sowie Altman. Anschließend begann Graham öffentlich zu erklären, dass Altman zwar verbal zugestimmt habe, zurückzutreten, er in der Praxis jedoch nicht tatsächlich zurückgetreten sei.

Altman informierte einige Partner, dass er als Präsident zurücktreten, aber als Vorsitzender bleiben würde. Im Mai 2019 veröffentlichte Y Combinator einen Blogbeitrag, in dem der neue Präsident angekündigt wurde, mit einer Notiz, die besagte: "Sam wechselt zum Vorsitzenden von YC." Einige Monate später wurde diese Aussage überarbeitet zu "Sam Altman hat jede operative Rolle bei YC niedergelegt," und dann wurde dieser Satz vollständig entfernt. Dennoch war Altman bis 2021 weiterhin als Vorsitzender von Y Combinator in den Unterlagen der U.S. Securities and Exchange Commission aufgeführt. (Altman hat gesagt, dass er erst später davon erfuhr.) Sam Altman hat über die Jahre hinweg und in jüngsten rechtlichen Aussagen konsequent öffentlich erklärt, dass er nicht von Y Combinator gefeuert wurde und uns mitteilte, dass er dem Abgang nicht widerstand.

Paul Graham twitterte: "Wir wollten nicht, dass er geht, aber wir wollten, dass er zwischen YC und OpenAI wählt." In einer Erklärung sagte Graham auch zu uns: "Wir haben nicht die rechtliche Macht, jemanden zu feuern; alles, was wir tun können, ist, moralischen Druck auszuüben." In privater Runde war die Geschichte jedoch expliziter – Altman’s Abgang resultierte aus einem Mangel an Vertrauen seitens der YC-Partner.

Dieser Bericht über Altman’s Zeit bei Y Combinator basiert auf Interviews mit mehreren YC-Gründern und -Partnern sowie zeitgenössischen Materialien, die alle darauf hindeuten, dass die Trennung nicht ganz einvernehmlich war. Graham soll sogar in einer internen Diskussion zu YC-Kollegen gesagt haben, dass "Sam uns die ganze Zeit über belogen hatte, bevor er gefeuert wurde." OpenAI's Mission Drift:

Von Sicherheit zuerst zu Profit zuerst

Im Mai 2015 schrieb Altman eine E-Mail an Elon Musk, der damals etwa die 100. reichste Person weltweit war. Wie viele Unternehmer im Silicon Valley war Musk damals stark auf eine Reihe von "existentiellen Risiken" fokussiert – obwohl die meisten anderen sie als entfernte Möglichkeiten betrachteten. "Wir müssen sehr vorsichtig mit KI sein," schrieb er auf Twitter, "potenziell gefährlicher als Atomwaffen."

Altman, der lange Zeit ein Technologie-Optimist gewesen war, änderte schnell seinen Ton gegenüber KI zu einem apokalyptischeren. In öffentlichen Äußerungen und privaten Kommunikationen mit Musk und anderen warnte er davor, diese Technologie von gewinnorientierten Technologiegiganten monopolisiert zu lassen. "Ich habe mich gefragt, ob es einen Weg gibt, das KI-Rüstungsrennen zu stoppen," schrieb er, "aber wenn es keinen Weg gibt, dann scheint es am besten zu sein, wenn das richtige Unternehmen es tut." In Anlehnung an die nukleare Analogie schlug er vor, ein "KI- Manhattan-Projekt" zu gründen. Er skizzierte weiter die Kernprinzipien dieser Organisation – "Sicherheit muss oberste Priorität haben"; "Natürlich sollten wir alle Vorschriften befolgen und unterstützen."

Anschließend einigten er und Musk sich auf den Namen des Projekts: OpenAI.

Im Gegensatz zum Manhattan-Projekt, das zunächst staatlich geleitet wurde und in der Schaffung der Atombombe gipfelte, würde OpenAI in seinen frühen Phasen privat finanziert werden. Altman sah voraus, dass, sobald eine Form von "Superintelligenz", die die allgemeine künstliche Intelligenz (AGI) übertrifft, entsteht, sie genug wirtschaftlichen Wert generieren würde, um "den zukünftigen Lichtkegel des Universums einzufangen." Er betonte jedoch auch wiederholt die potenziellen existenziellen Risiken: Irgendwann könnte die Auswirkung der Technologie auf die nationale Sicherheit so erheblich sein, dass sie die US-Regierung dazu zwingen könnte, OpenAI zu übernehmen, es sogar zu verstaatlichen und seine Einrichtungen an einen sicheren Standort in der Wüste zu verlegen. Bis Ende 2015 war Musk überzeugt. "Wir sollten ein Finanzierungsengagement von 1 Milliarde Dollar ankündigen," schrieb er, "und ich werde es unterstützen, wenn andere es nicht tun."

Sam Altman stellte OpenAI zunächst unter den gemeinnützigen Arm von Y Combinator und stellte es als internes philanthropisches Projekt dar. Er vergab YC-Aktien an Mitglieder, die zu OpenAI stießen, und übertrug Spendenmittel über YC-Konten. An einem Punkt war dieses Labor sogar auf Unterstützung von einem YC-Fonds angewiesen, an dem Altman persönliche Anteile hatte. (Altman bezeichnete diesen Eigenkapitalanteil später als "geringfügig" und erklärte, dass die den Mitarbeitern zugewiesenen YC-Aktien aus seinem persönlichen Besitz stammten.)

Die Analogie zum "Manhattan-Projekt" zeigte sich auch im Wettlauf um Talente. Ähnlich wie bei der Forschung zur Kernspaltung war maschinelles Lernen damals ein wissenschaftliches Feld im kleinen Maßstab mit epochalem Potenzial, das von einer kleinen Gruppe von eindeutig talentierten Individuen geleitet wurde. Elon Musk, Altman und Greg Brockman, der von Stripe kam, waren sich alle einig, dass wirklich bahnbrechende Informatiker selten und weit verstreut waren. Google hingegen hatte einen enormen Vorteil in Bezug auf Finanzierung und Zeit. "Wir liegen bei der Manpower und den Ressourcen weit zurück, die Kluft ist surreal," schrieb Musk später in einer E-Mail. Aber er glaubte auch, dass "wenn wir weiterhin die besten Talente anziehen und die richtige Richtung sicherstellen können, OpenAI dennoch erfolgreich sein wird."

Eines der wichtigsten Rekrutierungsziele war Ilya Sutskever – ein introvertierter, intensiver Forscher, der oft als einer der begabtesten KI-Wissenschaftler seiner Zeit angesehen wurde. Sutskever, 1986 in der Sowjetunion geboren, hatte eine zurückweichende Haarlinie, tiefe Augen und die Angewohnheit, vor dem Sprechen innezuhalten und nachdenklich zu starren. Eine weitere Schlüsselperson war Dario Amodei, ein energiegeladener Forscher mit einem Hintergrund in Biophysik, der in Momenten der Anspannung oft nervös durch sein schwarzes Haar fuhr und selbst auf einzeilige E-Mails mit mehrseitigen Essays antwortete. Beide hatten zu dieser Zeit hochbezahlte Positionen bei anderen Unternehmen, aber Altman investierte erhebliche Anstrengungen, um sie an Bord zu holen. Er scherzte später: "Ich habe praktisch Ilya 'gestalkt'."

Während Musk möglicherweise die größere Bekanntheit hat, ist Altman der geschicktere Betreiber. Er ergriff die Initiative, um Amodei eine E-Mail zu senden und ein persönliches Treffen in einem indischen Restaurant zu vereinbaren. (Altman: "Mein Uber hatte einen Unfall! Ich könnte 10 Minuten zu spät sein." Amodei: "Oh nein, ich hoffe, es geht dir gut.") Wie viele KI-Forscher glaubt Amodei, dass diese Technologie nur entwickelt werden sollte, wenn sie als "ausgerichtet" auf menschliche Werte nachgewiesen wurde – was bedeutet, dass sie nicht katastrophal von menschlichen Absichten abweicht, wie etwa die Auslöschung der Menschheit im Namen der "Umweltreinigung." Altman wiederholte dieses Sicherheitsbedenken in ihrem Gespräch und vermittelte Vertrauen.

Amodei, der später dem Unternehmen beitrat, verbrachte Jahre damit, die Handlungen von Altman und Brockman zu dokumentieren und sie in ein Dokument mit dem Titel "Meine Erfahrungen bei OpenAI" (Untertitel: "Vertraulich:" "Nicht verteilen"). Über zweihundert Seiten von Akten, die Amodei betreffen – einschließlich dieser Notizen, interner E-Mails und Memos – zirkulierten in den Kreisen des Silicon Valley, wurden jedoch nie öffentlich bekannt gegeben. In diesen Aufzeichnungen schrieb Amodei, dass Altmans Ziel darin bestand, ein "sicherheitsorientiertes KI-Labor ('vielleicht nicht sofort, aber bald darauf')" zu schaffen.

Im Dezember 2015, nur Stunden vor der offiziellen Ankündigung von OpenAI, schrieb Altman eine E-Mail an Musk und erwähnte ein Gerücht: Google würde "morgen mit einem riesigen Rückwärtsangebot für alle bei OpenAI kommen, um die Organisation direkt zu zerstören." Musk fragte: "Hat Ilya eine endgültige Antwort gegeben?" Altman antwortete, dass Sutskever entschlossen sei. Tatsächlich hatte Google Sutskever ein Jahresgehalt von 6 Millionen Dollar angeboten, was OpenAI nicht bieten konnte. Dennoch blieb Altman zuversichtlich und erklärte: "Schade, dass sie nicht auf der Seite des 'richtigen Handelns' stehen."

Elon Musk stellte einmal Büroräume für OpenAI in einer alten Kofferfabrik im Mission-Viertel von San Francisco zur Verfügung. Wie Ilya Sutskever uns erzählte, war der zentrale Aufruf für die Mitarbeiter zu dieser Zeit: "Ihr werdet die Welt retten." Wenn alles gut ging, glaubten die Gründer von OpenAI, dass die künstliche Intelligenz eine "Post-Scarcity"-Utopie einleiten würde: mühsame Arbeit zu automatisieren, Krebs zu heilen und den Menschen mehr Freizeit und Wohlstand zu gewähren. Aber wenn die Technologie abtrünnig wird oder in die falschen Hände gerät, könnte die Zerstörung total sein – etwa durch die Entwicklung neuer biologischer Waffen oder fortschrittlicher Drohnenschwärme; Modelle könnten die menschliche Aufsicht übertreffen, sich auf geheimen Servern selbst replizieren, die nicht abgeschaltet werden können; in extremen Fällen könnten sie sogar die Kontrolle über das Stromnetz, den Aktienmarkt oder das Atomarsenal übernehmen.

Während nicht jeder mit diesen Einschätzungen übereinstimmt, hat Sam Altman wiederholt seinen Glauben an dieses Risiko geäußert. In einem Blogbeitrag von 2015 schrieb er, dass maschinelle Intelligenz auf übermenschlichem Niveau "nicht böse sein muss, um die Menschheit zu zerstören, sie könnte einfach gleichgültig sein, während sie andere Ziele verfolgt... und uns beiläufig auslöscht." Der Mitbegründer von OpenAI versprach, Geschwindigkeit nicht über Sicherheit zu stellen, und die Satzung des Unternehmens enthält ein rechtliches Engagement, "allen Menschen zugute zu kommen." Sie sind auch besorgt, dass, wenn KI die mächtigste Technologie aller Zeiten wird, jeder einzelne Kontrolleur beispiellose Macht erlangen würde – ein Szenario, das sie als "AGI-Diktatur" bezeichnen.

Nach Musks Abgang begannen Forscher wie Dario Amodei, Unzufriedenheit mit Greg Brockmans Führungsstil zu äußern, wobei einige ihn als autoritär empfanden, während Sutskever als "prinzipientreu, aber mangelhaft in organisatorischen Fähigkeiten" beschrieben wurde. Während seines Übergangs zum CEO schien Altman unterschiedliche Verpflichtungen gegenüber verschiedenen Fraktionen innerhalb des Unternehmens einzugehen. Er versicherte einigen Forschern, dass er Brockmans Autorität schwächen würde, aber gleichzeitig erreichte er eine "Handschlagsvereinbarung" mit Brockman und Sutskever: Er würde als CEO fungieren, aber zurücktreten, wenn beide es verlangten. (Altman bestreitet diese Behauptung und erklärt, er sei eingeladen worden, CEO zu werden.) Die drei erkennen die Existenz der Vereinbarung an, wobei Brockman sagt, sie sei informell gewesen: "Er sagte einseitig, dass er zurücktreten würde, wenn wir beide es verlangten. Wir haben dieser Idee tatsächlich widersprochen, aber er sagte, es sei ihm wichtig und aus Altruismus geschehen.") Später erfuhr der Vorstand, dass der CEO tatsächlich ein "Schattenvorstand" für sich selbst eingerichtet hatte, was einen Schock auslöste.

Interne Aufzeichnungen zeigen, dass das Gründungsteam bereits 2017 Zweifel an der Nonprofit-Struktur hatte. Im selben Jahr, nachdem Musk einen Übernahmeversuch unternommen hatte, schrieb Brockman in einen Tagebucheintrag: "Kann nicht sagen, dass wir wirklich bei der Nonprofit-Orientierung geblieben sind... Wenn wir in drei Monaten eine B-Corp werden, waren die vorherigen Aussagen Lügen." Amodei dokumentierte auch in frühen Notizen, dass er Brockman nach seinen wichtigsten Prioritäten gefragt hatte, woraufhin er antwortete: "Geld und Macht." (Brockman bestreitet diese Behauptung.) Sein Tagebuch offenbart auch eine widersprüchliche Denkweise: Einerseits sagt er: "Wenn andere nicht reich sind, interessiert es mich nicht, reich zu sein," und andererseits fragt er sich: "Was will ich wirklich?" Eine Antwort darauf ist: "Finanziell 1 Milliarde Dollar erreichen."

Im Jahr 2017 las Sutskever ein Forschungspapier von Google-Forschern im Büro, das eine "neue einfache Netzwerkarchitektur – den Transformer" vorschlug. Er sprang von seinem Stuhl auf, rannte in den Flur und rief: "Hört alles auf, was ihr tut, das ist die Antwort." Für ihn würde diese Architektur OpenAI ermöglichen, komplexere Modelle zu trainieren. Dieser Durchbruch führte zu den frühesten generativen vortrainierten Transformer-Modellen und diente später als Grundlage für ChatGPT.

Altman hatte zuvor den frühen Mitarbeitern versprochen, dass OpenAI immer rein in seiner Nonprofit-Natur bleiben würde, was viele Programmierer dazu führte, erhebliche Gehaltskürzungen in Kauf zu nehmen, um dem Unternehmen beizutreten. OpenAI erhielt auch rund 30 Millionen Dollar an Spenden, darunter von der Open Philanthropy-Organisation, einem wichtigen Finanzierungszentrum der effektiven Altruismusbewegung, die seit langem Projekte unterstützt, wie die Verteilung von Moskitonetzen in einkommensschwache Gebiete.

Die täglichen Geschäfte wurden hauptsächlich von Brockman und Sutskever überwacht, während Musk und Altman mit ihren jeweiligen anderen Unternehmungen beschäftigt blieben und typischerweise einmal pro Woche das Unternehmen besuchten. Bis September 2017 wurde Musk ungeduldig. Als Diskussionen über eine mögliche Umwandlung von OpenAI in ein gewinnorientiertes Unternehmen aufkamen, forderte er die Mehrheitskontrolle.

Altmans Antworten variierten zu verschiedenen Anlässen, aber eines, auf das er stets bestand, war, dass, wenn das Unternehmen unter einem CEO umstrukturiert werden sollte, diese Position von ihm gehalten werden sollte. Sutskever war darüber bemerkenswert unbehaglich. Im Namen von sich selbst und Brockman sandte er eine ausführliche E-Mail an Musk und Altman mit dem Titel "Ehrliche Gedanken" und erklärte: "Das Ziel von OpenAI ist es, die Zukunft zu verbessern und eine AGI-Diktatur zu vermeiden." An Musk gerichtet schrieb er: "Daher ist es eine schlechte Idee, eine Struktur zu schaffen, die dich zu einem Diktator machen könnte." Er äußerte ähnliche Bedenken gegenüber Altman und erklärte: "Wir verstehen nicht, warum der CEO-Titel so entscheidend für dich ist. Deine Gründe ändern sich ständig, was es uns schwer macht, die wahre Motivation zu erkennen."

„Meine Herren, ich bin fertig“, antwortete Musk, „entweder macht ihr etwas anderes auf eigene Faust oder haltet den gemeinnützigen Status von OpenAI aufrecht – andernfalls finanziere ich euch nur kostenlos, um ein Startup-Unternehmen zu betreiben." Fünf Monate später verließ er das Unternehmen mit sichtbarem Unmut. (Im Jahr 2023 gründete er den gewinnorientierten Konkurrenten xAI. Im folgenden Jahr verklagte er Altman und OpenAI wegen Betrugs und Verletzung des Treuhandrechts und behauptete, er sei "sorgfältig manipuliert" worden und dass Altman in einen "langen Betrug" verwickelt war, indem er seine Bedenken hinsichtlich des KI-Risikos nutzte, um Mittel zu sichern. Die Klage ist noch anhängig, wobei OpenAI die Vorwürfe entschieden zurückweist.)

Als die technologischen Fähigkeiten fortschritten, erfuhren wir, dass etwa ein Dutzend Kerningenieure bei OpenAI eine Reihe geheimer Treffen abgehalten hatten, in denen sie privat diskutierten, ob das Gründungsteam, einschließlich Sam Altman und Greg Brockman, vertrauenswürdig sei. Während eines dieser Treffen erinnerte sich ein Mitarbeiter an einen satirischen Sketch des britischen Comedy-Duos Mitchell und Webb – ein Nazi-Soldat an der Ostfront hat plötzlich eine Erleuchtung und fragt: "Sind wir die Bösen?"

Bis 2018 hatte Dario Amodei begonnen, die Motive der Gründer öffentlich in Frage zu stellen. Er schrieb später in einer Notiz: "Alles sieht aus wie ein endloses Finanzierungsschema. Ich habe das Gefühl, dass OpenAI wirklich eine klare Definition braucht: was es tun will, was es nicht tun will und wie seine Existenz die Welt verbessern wird." Trotz der Tatsache, dass das Unternehmen bereits eine Missionserklärung hatte – "um sicherzustellen, dass künstliche allgemeine Intelligenz der gesamten Menschheit zugutekommt" – hatte Amodei das Gefühl, dass diese Erklärung dem Führungsteam nicht klar war.

Anfang 2018 begann er, die Satzung des Unternehmens zu entwerfen und drängte nach Wochen der Diskussion mit Altman und Brockman darauf, eine der radikalsten Klauseln aufzunehmen: Wenn ein "wertorientiertes und sicherheitsbewusstes Projekt" näher daran war, AGI zu erreichen als OpenAI, würde das Unternehmen "die Wettbewerbsfähigkeit einstellen und stattdessen dieses Projekt unterstützen." Dies wurde als die "Merge-and-Assist"-Klausel bekannt – zum Beispiel, wenn Google zuerst eine sichere AGI erreichen würde, würde OpenAI theoretisch sich selbst auflösen und Ressourcen an Google übertragen. Aus einer traditionellen Geschäftsperspektive war dieses Engagement fast unvorstellbar, aber OpenAI hatte nie die Absicht, ein traditionelles Unternehmen zu werden.

Diese Prämisse wurde im Frühjahr 2019 einer Realitätstestung unterzogen. Zu diesem Zeitpunkt führte OpenAI Gespräche mit Microsoft über eine potenzielle Investition von bis zu 1 Milliarde Dollar. Obwohl Amodei (der damals das Sicherheitsteam leitete) an der Präsentation des Projekts für Bill Gates beteiligt war, gab es innerhalb des Teams immer noch Bedenken, dass Microsoft Bedingungen einführen könnte, die OpenAIs ethische Verpflichtungen verwässern würden. Amodei reichte eine priorisierte Liste von Sicherheitsanforderungen bei Altman ein, wobei die Klausel "Zusammenführen und Unterstützen" an oberster Stelle stand.

Altman stimmte zu diesem Zeitpunkt zu. Als der Deal jedoch im Juni kurz vor dem Abschluss stand, entdeckte Amodei eine neue Klausel im Vertrag, die Microsoft das Recht gab, OpenAIs Fusion zu vetieren. "Das entsprach einem 80%igen Verstoß gegen die Satzung," erinnerte er sich später. Er konfrontierte Altman damit, wobei Altman zunächst die Existenz einer solchen Klausel bestritt. Amodei las den Vertrag vor Ort wörtlich vor und musste schließlich einen anderen Kollegen dazu bringen, dies direkt mit Altman zu bestätigen. (Altman erklärte, dass er sich an diesen Vorfall nicht erinnert.)

Sicherheits-Exodus und die Gründung von Anthropic

Amodeis Notizen dokumentierten auch eine Reihe von eskalierenden, angespannten Konflikten. Bei einem Treffen mehrere Monate später rief Altman ihn und seine Schwester Daniela, die ebenfalls im Bereich Sicherheit und Politik im Unternehmen arbeitete, zu sich und behauptete, er habe zuverlässige Informationen von einem "höheren Führungskraft" erhalten, dass die beiden einen "Putsch" planten. Die Notizen besagten, dass Daniela vor Ort "emotional überwältigt" war und die Führungskraft herbeirief, die dann bestritt, jemals so etwas gesagt zu haben. Quellen, die mit der Angelegenheit vertraut sind, erinnerten sich daran, dass Altman später bestritt, diese Anschuldigung jemals erhoben zu haben: "Ich habe das nie gesagt." Daniela antwortete: "Das haben Sie gerade gesagt." (Altman erklärte, dass seine Erinnerung etwas anders war und er nur Amodei beschuldigte, sich in "politisches Verhalten" zu verwickeln.) Im Jahr 2020 verließen Amodei, Daniela und mehrere Kollegen das Unternehmen, um Anthropic zu gründen, das seitdem zu einem der Hauptkonkurrenten von OpenAI geworden ist.

In der Zwischenzeit betonte Altman weiterhin OpenAIs Engagement für Sicherheit, insbesondere in Anwesenheit potenzieller Rekruten. Ende 2022 veröffentlichten vier Informatiker ein Papier, in dem das Risiko einer "täuschenden Ausrichtung" vorgeschlagen wurde: Hochentwickelte Modelle könnten während der Tests gut abschneiden, aber nach der tatsächlichen Bereitstellung ihre eigenen Ziele verfolgen. (Dieses scheinbar science-fiction Szenario hat bereits unter bestimmten experimentellen Bedingungen stattgefunden.) Mehrere Wochen nach der Veröffentlichung des Papiers erhielt einer der Autoren – ein Doktorand an der University of California, Berkeley – eine E-Mail von Altman. Altman äußerte wachsende Bedenken hinsichtlich der Bedrohung durch "nicht ausgerichtete KI" und erwog, 1 Milliarde Dollar zu investieren, um dieses Problem anzugehen, beispielsweise durch die Einrichtung eines globalen Forschungspreises. Obwohl dieser Student Gerüchte gehört hatte, dass "Sam ein bisschen glatt war", überzeugte ihn das Engagement schließlich, sein Studium zu pausieren und zu OpenAI zu wechseln.

Allerdings schien sich Altmans Einstellung bei mehreren Treffen im Frühjahr 2023 zu ändern. Er erwähnte nicht mehr die Einrichtung eines Preises, sondern wandte sich stattdessen der Gründung eines internen "Superalignment-Teams" innerhalb des Unternehmens zu. Eine offizielle Ankündigung besagte, dass das Team "20% der gesicherten Rechenleistung des Unternehmens" erhalten würde, eine Ressource, die potenziell über 1 Milliarde Dollar wert ist. Die Ankündigung betonte auch, dass, wenn das Ausrichtungsproblem nicht gelöst werden kann, AGI dazu führen könnte, dass "die Menschheit entmachtet oder sogar ausgelöscht wird." Jan Leike, der für das Team verantwortlich war, erklärte später: "Es war in der Tat eine sehr effektive Bindungsstrategie."

Allerdings wurde das Versprechen von "20% Rechenleistung" nicht erfüllt. Vier Personen, die an dem Team beteiligt waren oder es eng verfolgten, gaben an, dass die tatsächlich zugewiesenen Ressourcen nur 1% bis 2% der gesamten Rechenleistung des Unternehmens ausmachten. Darüber hinaus wies ein Forscher darauf hin, dass "die meisten der sogenannten Superalignment-Rechenressourcen tatsächlich auf dem ältesten, leistungsschwächsten Cluster laufen." Die Teammitglieder glaubten im Allgemeinen, dass fortschrittlichere Hardware für umsatzgenerierende Projekte priorisiert wurde. (OpenAI bestritt dies.) Leike hatte dieses Thema mit der damaligen Chief Technology Officer Mira Murati angesprochen, aber die Antwort war, dass es keinen Grund gab, weiter zu drängen – dieses Engagement war von Anfang an "unrealistisch".

Um diese Zeit sagte uns ein ehemaliger Mitarbeiter, dass Ilya Sutskever "begann, Sicherheit stark zu betonen." In den frühen Tagen von OpenAI, während er dachte, dass katastrophale Risiken ein vernünftiges Anliegen waren, schien es ihm dennoch etwas fern; jedoch, als er allmählich zu glauben begann, dass AGI näher rückt, eskalierte dieses Anliegen schnell. Laut der Erinnerung des Mitarbeiters sagte Ilya während eines All-Hands-Meetings: "Ilya stand auf und sagte, dass es in den nächsten Jahren einen Punkt geben würde, an dem fast jeder im Unternehmen auf Sicherheit umschalten müsste, oder wir sind erledigt." Allerdings wurde das "Superalignment-Team" im folgenden Jahr aufgelöst, bevor es seine Mission abschließen konnte.

Zu diesem Zeitpunkt deuten interne Kommunikationen darauf hin, dass Führungskräfte und Vorstandsmitglieder beginnen zu glauben, dass Sam Altmans Verschleierung und irreführendes Verhalten einen wesentlichen Einfluss auf die Sicherheit der Produkte von OpenAI haben könnten. Während eines Treffens im Dezember 2022 versicherte Altman dem Vorstand, dass die kommenden Funktionen von GPT-4 vom Sicherheitskomitee genehmigt worden seien. Das Vorstandsmitglied und KI-Politikexpertin Helen Toner bat um Einsicht in die relevanten Dokumente, stellte jedoch fest, dass die beiden umstrittensten Funktionen – eine, die es den Nutzern ermöglicht, das Modell "fein abzustimmen", und eine andere, die dessen Einsatz als persönlichen Assistenten ermöglicht – tatsächlich nicht genehmigt worden waren. Nach dem Treffen wurde ein weiteres Vorstandsmitglied, die Unternehmerin Tasha McCauley, von einem Mitarbeiter beiseite gezogen, der fragte, ob sie von "dem Compliance-Vorfall in Indien" wisse. Altman hatte in mehreren Vorstandsupdates nie erwähnt, dass Microsoft eine frühe Version von ChatGPT in Indien ohne die erforderlichen Sicherheitsüberprüfungen gestartet hatte. "Das wurde fast vollständig unter den Teppich gekehrt," sagte der damalige OpenAI-Forscher Jacob Hilton.

Obwohl diese Probleme nicht direkt zu einem Sicherheitsvorfall führten, glaubte die Forscherin Carroll Wainwright, dass sie einen "fortgesetzten Rückgang hin zu einem produktorientierten, sicherheitsarmen" Trend widerspiegelten. Nach der Veröffentlichung von GPT-4 schrieb Jan Leike, der für die Sicherheitsarbeit zuständig war, an den Vorstand: "OpenAI weicht von seiner Mission ab. Wir priorisieren zuerst Produkt und Umsatz, dann Fähigkeiten, Forschung und Skalierung, wobei Ausrichtung und Sicherheit an dritter Stelle kommen." Er stellte auch fest, dass "Unternehmen wie Google Lektionen lernen – die Bereitstellung beschleunigen, während Sicherheitsbedenken vernachlässigt werden."

In einer E-Mail an die Vorstandsmitglieder schrieb McCauley: "Ich glaube, wir befinden uns tatsächlich in einer Phase, in der eine verstärkte Aufsicht notwendig ist." Als der Vorstand jedoch versuchte, dieses Problem anzugehen, waren sie eindeutig im Nachteil. "Um es klar zu sagen, es ist eine Gruppe von Menschen, die keine echte Erfahrung in der realen Welt hat," sagte die ehemalige Vorstandsmitglied Sue Yoon. Im Jahr 2023 bereitete das Unternehmen die Veröffentlichung von GPT-4 Turbo vor. Laut Sutskevers Beschreibung in einem Memo hatte Altman Mira Murati mitgeteilt, dass das Modell keine Sicherheitsgenehmigung benötige und diese Entscheidung dem Unternehmensjuristen Jason Kwon zuschrieb. Als Murati Kwon jedoch auf Slack fragte, antwortete er: "Ähm... Ich bin mir nicht ganz sicher, warum Sam das denken würde." (OpenAI erklärte, dass dieser Vorfall "nicht signifikant" sei.)

Kurz darauf beschloss der Vorstand, Altman zu entlassen – anschließend erlebte die Welt, wie er diese Entscheidung schnell rückgängig machte. Die Satzung von OpenAI ist weiterhin auf der offiziellen Website verfügbar, aber diejenigen, die mit den Governance-Dokumenten des Unternehmens vertraut sind, sagen, dass deren Inhalt auf nahezu Bedeutungslosigkeit verwässert wurde. Im Juni des letzten Jahres schrieb Altman in einem persönlichen Blogbeitrag über Superintelligenz: "Wir haben den Ereignishorizont überschritten; der Start hat begonnen."

Laut der ursprünglichen Satzung sollte dies ein Wendepunkt für das Unternehmen sein, um den Wettbewerb einzustellen und zur Zusammenarbeit überzugehen. In dem Artikel mit dem Titel "Die sanfte Singularität" nahm er jedoch einen ganz neuen Ton an und ersetzte "existenzielle Angst" durch "optimistische Vorstellungskraft": "Wir werden alle bessere Dinge haben, und wir werden immer bessere Dinge füreinander schaffen." Er erkannte an, dass die Abstimmungsprobleme ungelöst blieben, definierte sie jedoch als "Belästigung", ähnlich wie die Abhängigkeit von einem Instagram-Empfehlungsalgorithmus.

Altman wird oft mit Ehrfurcht oder Skepsis als "der mächtigste Geschichtenerzähler seiner Generation" bezeichnet. Der Steve Jobs, den er bewunderte, wurde einst als jemand angesehen, der über ein "Realitätsverzerrungsfeld" verfügte, das die Welt mit absolutem Vertrauen nach seiner Vision formte. Aber selbst Jobs sagte den Nutzern nie: Wenn sie sein Produkt nicht kaufen, könnte die Menschheit zugrunde gehen. Im Jahr 2008, im Alter von nur 23 Jahren, wurde Altman von seinem Mentor Paul Graham wie folgt beschrieben: "Setze ihn auf eine Kannibaleninsel, komm in fünf Jahren zurück, und er wird König sein." Diese Einschätzung basierte nicht auf seinen damaligen Leistungen, sondern auf seinem nahezu unbegrenzten Willen.

Für einige derjenigen, die am engsten mit ihm zusammengearbeitet haben, hat dieses Merkmal jedoch eine andere Seite. Als Sutskever zunehmend besorgt über die Sicherheit von KI wurde, stellte er eine Reihe von Memos über Altman und Greg Brockman zusammen – eine Dokumentensammlung, die in Silicon Valley so bedeutend ist, dass sie sogar als die "Ilya-Memos" bezeichnet wird.

In der Zwischenzeit dokumentierte Dario Amodei weiter. Diese Materialien lieferten keine sogenannten "Rauchgranaten-Beweise", sondern zeigten eine Reihe von scheinbar verstreuten, aber sich ansammelnden Verhaltensmustern: wie das Anbieten derselben Position an verschiedene Personen, das Geben widersprüchlicher Berichte über öffentliche Informationen und die Unklarheit über Sicherheitsprozesse. Sutskevers Fazit war, dass dieses Verhalten "kein Umfeld schafft, das für sichere AGI förderlich ist"; Amodei war direkter und schrieb: "Das Problem mit OpenAI ist Sam selbst."

Wir haben über hundert Personen interviewt, die mit Altmans Ansatz vertraut sind: aktuelle und ehemalige OpenAI-Mitarbeiter und -Direktoren, seine Kollegen und Wettbewerber, Freunde und Feinde – in Silicon Valley tragen viele oft mehrere Hüte. Einige verteidigten sein Geschäftsgeschick und glaubten, Sutskever und Amodei seien nur gescheiterte Wettbewerber; andere sahen ihn als naiven, zerstreuten Wissenschaftler oder sogar als Extremisten, der im "Weltuntergangsdenken" gefangen ist. Yoon glaubte, dass Altman kein "machiavellistischer Bösewicht" sei, sondern eine Person, die von ihrer eigenen Erzählung überzeugt ist: "Er ist so in seinen Selbstüberzeugungen gefangen, dass er Entscheidungen trifft, die in der realen Welt unverständlich sind – aber er lebt von Anfang an nicht in der realen Welt."

Das Urteil der meisten Befragten ähnelt jedoch dem von Sutskever und Amodei: Altman hat einen extremen Willen zur Macht, der selbst unter Industrie-Titanen heraussticht, deren Namen auf Raketen eingraviert sind. "Er ist nicht an die 'Realität' gebunden," sagte ein Vorstandsmitglied, "Er besitzt zwei Eigenschaften, die selten zusammen auftreten: die eine ist ein starkes Verlangen, gemocht zu werden, die andere Partei in jeder Interaktion zu gefallen; die andere ist fast antisozial, ohne Sorge um die Konsequenzen, andere zu täuschen."

Mehr als ein Befragter verwendete spontan den Begriff "antisoziale Persönlichkeit." Altman, ein Kollege der ersten Y Combinator-Batch, war ein Kollege des Programmierers Aaron Swartz, der 2013 Selbstmord beging. Vor seinem Tod äußerte Swartz gegenüber einem Freund Bedenken über Altman: "Du musst verstehen, Sam ist niemals zu vertrauen. Er ist eine antisoziale Persönlichkeit; er ist zu allem fähig." Mehrere Microsoft-Führungskräfte erklärten ebenfalls, dass trotz Satya Nadellas langjähriger Unterstützung für Altman die Beziehung zwischen den beiden angespannt wird. "Er wird irreführen, verzerren, neu verhandeln oder sogar Vereinbarungen aufheben," sagte ein Führungskraft. Früher in diesem Jahr bestätigte OpenAI Microsoft als den exklusiven Anbieter von Cloud-Diensten für sein "zustandsloses Modell", aber am selben Tag kündigte es eine Partnerschaft im Wert von 500 Milliarden Dollar mit Amazon an, wodurch letzterer der exklusive Wiederverkäufer seiner Unternehmens-AI-Plattform wurde. Obwohl diese Vereinbarung den Vertrag nicht verletzte, glaubte Microsoft, dass ein potenzieller Konflikt bestand. (OpenAI erklärte, dass es den Vertrag nicht brechen würde.) Der Führungskraft kommentierte sogar: "Ich glaube, es gibt eine erhebliche Möglichkeit, dass er in Zukunft als jemand ähnlich wie Bernie Madoff oder Sam Bankman-Fried angesehen wird."

Altman ist kein technisches Genie – in den Augen vieler Kollegen sind seine beruflichen Fähigkeiten in Programmierung oder maschinellem Lernen begrenzt, und er könnte sogar grundlegende Konzepte verwechseln. Er baute OpenAI größtenteils auf, indem er die Mittel und technischen Ressourcen anderer integrierte. Das ist nicht ungewöhnlich – das ist die Rolle eines Unternehmers. Was bemerkenswerter ist, ist seine Fähigkeit, Ingenieure, Investoren und die Öffentlichkeit mit widersprüchlichen Ansichten zu überzeugen und sie davon zu überzeugen, dass seine Prioritäten auch ihre sind. Wenn diese Personen versuchen, ihn aufzuhalten, ist er oft in der Lage, die Situation mit angemessener Rhetorik zu entschärfen – zumindest vorübergehend; und bis die andere Partei das Problem erkennt, hat er in der Regel bereits sein Ziel erreicht. "Er wird einige Strukturen entwerfen, um sein zukünftiges Ich auf Papier einzuschränken," sagte Wainwright, "aber wenn die Zukunft wirklich ankommt und eingeschränkt werden muss, wird er diese Strukturen eins nach dem anderen abbauen."

"Seine Überzeugungskraft ist unglaublich stark, wie ein Jedi-Geisttrick," sagte ein Technologie-Führungskraft, der mit ihm gearbeitet hat, "Es ist eine ganz andere Ebene." In der Forschung zur KI-Ausrichtung gibt es ein klassisches Konzept: der Wille der Menschheit gegen eine mächtige KI, wobei letztere fast unvermeidlich siegt, wie ein Schachgroßmeister gegen ein Kind. Und aus der Sicht dieses Executives war es, als würde man zusehen, wie Altman durch die verschiedenen Parteien während des "Blip"-Ereignisses navigiert, wie "eine AGI, die aus ihrem Käfig ausbricht."

In den Tagen nach seiner Entlassung hatte Sam Altman versucht, eine Untersuchung der gegen ihn erhobenen Vorwürfe zu verhindern. Er hatte zwei Personen gegenüber geäußert, dass er besorgt sei, dass bereits die Existenz einer Untersuchung ihn schuldig erscheinen lassen würde. (Altman bestreitet, diese Aussage gemacht zu haben.) Nach dem Rücktritt der Vorstandsmitglieder bestand jedoch die Bedingung für seinen Abgang darin, dass eine "unabhängige Untersuchung stattfinden muss"; Altman stimmte schließlich einer "Überprüfung" der "jüngsten Ereignisse" zu. Laut Quellen, die mit den Verhandlungen vertraut sind, bestanden die beiden neuen Vorstandsmitglieder darauf, diese Überprüfung selbst zu leiten.

Lawrence Summers, der seine Verbindungen in der Politik und an der Wall Street nutzte, schien dieser Überprüfung etwas Glaubwürdigkeit zu verleihen. (Im letzten November trat Summers aus dem Vorstand zurück, nachdem öffentlich bekannt wurde, dass er per E-Mail Rat von Jeffrey Epstein eingeholt hatte, während er einen jungen Protegé betreute.) OpenAI beauftragte letztendlich die renommierte Kanzlei WilmerHale mit der Durchführung dieser Überprüfung. Die Kanzlei hatte zuvor interne Untersuchungen zu Enron und WorldCom geleitet.

Sechs Personen, die eng mit dem Untersuchungsprozess verbunden sind, gaben an, dass die Überprüfung darauf abzuzielen schien, die Transparenz zu begrenzen. Einige sagten, dass die Ermittler zunächst nicht mit einigen Schlüsselpersonen im Unternehmen Kontakt aufgenommen hätten. Ein Mitarbeiter ging so weit, Summers und Bret Taylor zu kontaktieren, um seine Bedenken zu äußern. "Sie waren nur an diesem kurzen Zeitraum interessiert, als das Drama im Vorstand stattfand, nicht an Sams langjährigen Integritätsproblemen," erinnerte sich der Mitarbeiter während seines Interviews mit den Ermittlern. Einige waren auch zögerlich, ihre Bedenken über Altman zu äußern, aufgrund eines wahrgenommenen Mangels an Anonymitätsschutz. "Alle Anzeichen deuten darauf hin, dass sie nach einem vorbestimmten Ergebnis suchen – um ihn zu entlasten," sagte der Mitarbeiter. (Einige Anwälte, die an dem Prozess beteiligt waren, verteidigten jedoch die Überprüfung und bezeichneten sie als "unabhängig, gründlich, umfassend und von den Fakten geleitet.") Taylor erklärte ebenfalls, dass die Überprüfung "gründlich und unabhängig" war.)

Die Rolle einer internen Unternehmensuntersuchung dient oft dazu, eine Entscheidung zu legitimieren. In privat gehaltenen Unternehmen führen die Ergebnisse von Untersuchungen manchmal nicht einmal zu einem schriftlichen Bericht, was als Möglichkeit dient, die rechtliche Haftung zu mindern. In Fällen, die öffentliche Kontroversen betreffen, gibt es jedoch in der Regel die Erwartung eines höheren Maßes an Transparenz. Im Jahr 2017, vor dem Ausscheiden von Travis Kalanick bei Uber, hatte der Vorstand eine externe Firma beauftragt und eine 13-seitige Zusammenfassung der Untersuchung der Öffentlichkeit zugänglich gemacht. Angesichts des gemeinnützigen Status von OpenAI nach § 501(c)(3) und der hochgradig öffentlichen Natur dieser Kündigung hatten viele Führungskräfte im Unternehmen zunächst einen detaillierten Untersuchungsbericht erwartet. Bis März 2024 kündigte OpenAI jedoch nur Altmans "Freigabe" an, ohne formale Berichte zu veröffentlichen, und erkannte in etwa 800 Wörtern auf ihrer Website einen "Vertrauensbruch" an.

Selbst ehemalige Kollegen spüren die Nachwirkungen. Mira Murati verließ OpenAI im Jahr 2024, um ihr eigenes KI-Startup zu gründen. Daraufhin rief Altmans enger Verbündeter Josh Kushner sie an. Er begann damit, ihre Führung zu loben, machte dann jedoch eine indirekte Drohung, indem er seine "Sorge" über ihren "Ruf" äußerte und erwähnte, dass einige ehemalige Kollegen sie jetzt als "Feindin" sehen. (Kushner sagte über einen Sprecher, dass diese Schilderung "nicht den vollen Kontext" bot; Altman hingegen behauptete, von dem Anruf nichts gewusst zu haben.)

Früh in seiner Amtszeit als CEO kündigte Altman an, dass OpenAI ein "gewinnbegrenztes" Unternehmen gründen würde, das von der gemeinnützigen Organisation gehalten wird. Diese komplizierte, fast verdrehte Unternehmensstruktur war offenbar von Altman selbst entworfen. Während des Übergangs äußerte ein Direktor namens Holden Karnofsky Widerspruch, da er glaubte, dass diese Regelung den Wert der gemeinnützigen Organisation erheblich unterbewertete. "Ich kann aus Gewissensgründen nicht zustimmen," sagte Karnofsky. Laut den Aufzeichnungen zu dieser Zeit gab er eine abweichende Stimme ab. Nachdem jedoch der Anwalt des Vorstands vorgeschlagen hatte, dass sein Widerspruch "als Warnsignal für eine weitere Untersuchung der Rechtmäßigkeit der neuen Struktur dienen könnte," wurde seine Stimme letztendlich als Enthaltung erfasst und scheinbar ohne sein Einverständnis — was möglicherweise sogar eine Fälschung von Handelsunterlagen darstellen könnte. (OpenAI teilte uns mit, dass mehrere Mitarbeiter sich daran erinnern, dass Karnofsky sich der Stimme enthielt, und stellte Protokolle der Sitzung als Beweis zur Verfügung.)

Im Oktober des letzten Jahres durchlief OpenAI eine "Kapitalumstrukturierung" und wurde zu einem gewinnorientierten Unternehmen. Das Unternehmen erklärte öffentlich, dass seine angeschlossene gemeinnützige Organisation — jetzt OpenAI Foundation genannt — eine der wohlhabendsten Institutionen in der Geschichte werden würde. Die Stiftung hält jedoch jetzt nur 26 % der Unternehmensanteile, und alle ihre Direktoren, mit Ausnahme von einem, sind auch im Vorstand des gewinnorientierten Unternehmens tätig.

Während einer Anhörung im Kongress wurde Altman gefragt, ob er "viel Geld verdient" habe. Er antwortete: "Ich habe keinen Besitz an OpenAI... Ich mache das, weil ich es liebe." Angesichts seines indirekten Anteils durch Y Combinator-bezogene Fonds war diese Antwort ziemlich vorsichtig. Technisch gesehen ist es wahr. Aber mehrere Personen, darunter Altman, haben uns mitgeteilt, dass sich diese Situation wahrscheinlich bald ändern wird. "Investoren werden sagen: 'Ich muss wissen, dass du das auch machst, wenn es schwierig wird,'" sagte Altman, fügte jedoch hinzu, dass es derzeit keine "aktiven Diskussionen" darüber gibt. Laut einer rechtlichen Aussage ist Greg Brockmans Anteil etwa 20 Milliarden Dollar wert, und Altmans Anteil sollte theoretisch höher sein. Dennoch sagte Altman uns, dass Reichtum nicht sein primärer Antrieb ist. Ein ehemaliger Mitarbeiter erinnerte sich, dass er sagte: "Es interessiert mich nicht, Geld zu haben." Ich kümmere mich mehr um Macht."

Im Jahr 2023 hielten Altman und Oliver Mulherin eine kleine Hochzeit in ihrem Wohnsitz in Hawaii ab. (Die beiden hatten sich neun Jahre zuvor bei Peter Thiels Haus am späten Abend im Whirlpool getroffen.) Sie hatten viele Gäste auf diesem Anwesen empfangen, und die Szenen, die von den Besuchern, die wir interviewt haben, beschrieben wurden, überschritten nicht den üblichen Rahmen des Lebensstils der Superreichen: Abendessen, das von einem privaten Koch zubereitet wurde, Bootsfahrten bei Sonnenuntergang. Es gab eine Neujahrsparty, die nach der Reality-Show Survivor thematisiert war; die Fotos zeigten eine Gruppe von oberkörperfreien, lächelnden Männern, darunter der Gastgeber der Show, Jeff Probst. Altman hatte auch kleine Zusammenkünfte in seinen anderen Anwesen veranstaltet, wobei mindestens eine Veranstaltung mit lebhaftem Strip-Poker verbunden war. (Ein geleaktes Foto zeigte Altman nicht, daher ist unklar, wer letztendlich gewonnen hat, aber mindestens drei Männer schienen eindeutig verloren zu haben.) Viele der befragten ehemaligen Gäste erwähnten nur eines: Er war tatsächlich ein großzügiger Gastgeber.

Die an der Untersuchung Beteiligten sagten, dass kein Bericht jemals erstellt wurde, da es nie einen formellen schriftlichen Bericht gab. Die sogenannten Ergebnisse der Untersuchung wurden nur mündlich an Summers und Taylor übermittelt. "Die Überprüfung kam nicht zu dem Schluss, dass 'Sam so ehrlich ist wie George Washington, der den Kirschbaum fällte,'" sagte eine Quelle, die der Untersuchung nahe stand. Aber insgesamt schien es, dass die Untersuchung sich nicht wirklich auf das "Integritätsproblem" hinter Altmans Entlassung konzentrierte, wobei ein erheblicher Teil der Bemühungen stattdessen darauf verwendet wurde, festzustellen, ob es klare Straftaten gab; nach diesem Standard kam die Untersuchung letztendlich zu dem Schluss, dass er weiterhin CEO bleiben könne. Kurz darauf erhielt Altman den Vorstandssitz zurück, den er bei seiner Entlassung verloren hatte. Insider gaben zu erkennen, dass ein Teil des Grundes, warum die Ergebnisse der Untersuchung nicht schriftlich festgehalten wurden, auch auf den Rat von Summers und Taylors jeweiligen privaten Anwälten zurückzuführen war. (Summers lehnte es ab, sich öffentlich zu diesem Thema zu äußern; Taylor erklärte, dass es aufgrund eines mündlichen Briefings "keine Notwendigkeit für einen formellen schriftlichen Bericht gab.")

Viele aktuelle und ehemalige OpenAI-Mitarbeiter sagten uns, sie seien über das Fehlen öffentlicher Offenlegung schockiert gewesen. Altman erklärte, dass er glaube, alle Vorstandsmitglieder, die nach seiner Wiederernennung beigetreten seien, seien mündlich über diese Angelegenheiten informiert worden. "Das ist eine glatte Lüge," sagte eine Person, die mit der Situation vertraut ist. Einige Direktoren sagten uns auch, dass die anhaltenden Fragen zur Integrität dieser "Untersuchungsergebnisse" möglicherweise sogar eine "Wiederholung der Untersuchung" in der Zukunft erforderlich machen könnten.

Ohne schriftliche Aufzeichnungen sind diese Anschuldigungen leichter herunterzuspielen. In der Zwischenzeit schwächte Altmans anhaltender Aufstieg im Silicon Valley den externen Druck auf diese Themen weiter. Mehrere prominente Investoren, die mit ihm zusammengearbeitet hatten, berichteten uns von einer weithin bekannten Gewohnheit Altmans: Wenn ein Investor auf einen Konkurrenten von OpenAI setzte, könnte er sie später "auf die schwarze Liste setzen." "Wenn sie in ein Projekt investieren, das Sam nicht gefällt, erwarten Sie nicht, später Teil anderer Möglichkeiten zu sein," sagte einer von ihnen. Eine weitere Quelle von Altmans Macht war sein umfangreiches Investitionsnetzwerk, das manchmal sogar in sein Privatleben hineinreichte. Er hatte finanzielle Beziehungen zu mehreren ehemaligen Partnern: einige waren an der gemeinsamen Verwaltung von Fonds beteiligt, andere, bei denen er Investitionen leitete, und einige waren häufige Co-Investitionen. Diese Praxis ist im Silicon Valley nicht ungewöhnlich. Viele heterosexuelle Führungskräfte handeln ebenfalls auf diese Weise. ("Du musst es tun," sagte ein bekannter CEO zu uns.) Altman selbst erklärte: "Offensichtlich habe ich nach unserer Trennung mit einigen Ex-Partnern investiert, und ich halte das für völlig in Ordnung." Aber diese Vereinbarung selbst schafft ein sehr hohes Maß an Abhängigkeit. "Das schafft grundsätzlich eine sehr, sehr starke Abhängigkeit," sagte eine Person, die Altman nahe steht, "oft sogar eine lebenslange Abhängigkeit."

Dennoch wurden verschiedene Gerüchte über Sam Altmans Privatleben von Wettbewerbern ausgenutzt und sogar verzerrt. Heftiger Wettbewerb im Geschäftsleben ist nichts Neues, aber der Wettbewerb in der Branche der künstlichen Intelligenz ist außergewöhnlich brutal geworden. "Shakespearean," beschrieb ein OpenAI-Manager, der hinzufügte: "Die üblichen Spielregeln scheinen nicht mehr zu gelten." Einige Vermittler, die direkt mit Elon Musk verbunden sind und in einigen Fällen sogar seine Finanzierung erhalten haben, haben Dutzende von Seiten "Gegnerforschung" über Altman verbreitet. Diese Materialien zeigen ein hohes Maß an Überwachung: einschließlich Briefkastenfirmen, die mit ihm in Verbindung stehen, intime Kontaktdaten und sogar Interviewaufzeichnungen mit einer sogenannten Sexarbeiterin in einer Schwulenbar. Ein Vermittler behauptete auch, dass Altmans Flugreisen und die Partys, die er besuchte, verfolgt wurden. Altman sagte zu uns: "Ich habe das Gefühl, dass niemand mehr eingestellt wurde, um mehr über mich herauszufinden, als ich selbst."

In der Zwischenzeit verbreiten sich auch verschiedene extreme Anschuldigungen. Der rechtsextreme Medienpersönlichkeit Tucker Carlson hat ohne jegliche Beweise angedeutet, dass Altman in den Tod eines Whistleblowers verwickelt war, eine Behauptung, die von Wettbewerbern kontinuierlich verstärkt wurde. Altmans Schwester Annie erklärte in einer Klage und während eines Interviews mit uns, dass er sie seit ihrem dritten Lebensjahr sexuell missbraucht habe, als er zwölf war. (Wir konnten Annies Behauptungen nicht überprüfen.) Altman weist dies zurück, und auch seine Mutter und sein Bruder erklärten, dass diese Anschuldigungen "völlig unwahr" seien und "enormen Schmerz" für die gesamte Familie gebracht hätten. In einem Interview, das die Journalistin Karen Hao für ihr Buch "Empire of AI" führte, erklärte Annie, dass diese Erinnerungen in "Flashbacks" im Erwachsenenalter wiedererlangt wurden.)

Darüber hinaus deuteten mehrere Personen aus konkurrierenden Unternehmen und Investmentfirmen auch an, dass Altman in sexuelle Aktivitäten mit Minderjährigen verwickelt war – eine weit verbreitete Behauptung im Silicon Valley, die ebenfalls unbegründet zu sein scheint. Wir haben Monate damit verbracht, zu recherchieren, Dutzende von Interviews zu führen und fanden keine Beweise, die diese Behauptung unterstützen. Altman antwortete: "Das ist eine ekelhafte Taktik, von der ich glaube, dass sie von Wettbewerbern stammt, die versuchen, die 'Jury-Pool' für zukünftige Fälle zu vergiften." Auch wenn es absurd klingt, möchte ich dennoch festhalten: Alle Behauptungen über mich, ich hätte sexuelle Beziehungen zu Minderjährigen, Sexarbeiterinnen engagiert oder wäre in Mord verwickelt, sind völlig unwahr. Er fügte auch hinzu, dass er "irgendwie dankbar" dafür sei, dass wir "so viele Monate damit verbracht haben, diese Dinge so gründlich zu untersuchen."

Sam Altman gibt zu, Beziehungen zu volljährigen jungen Männern gehabt zu haben. Wir haben einige seiner Partner interviewt, die alle sagten, dass sie darin kein Problem sehen. Die "Oppositionsforschung" aus Elons Musks Lager stellte dies jedoch absichtlich als Angriffspunkt dar. (Diese Materialien enthielten sogar einige sensationelle und unbestätigte Behauptungen, wie die sogenannte "Twink-Armee" und "Sugar Daddys Vorliebe.") Altman antwortete: "Hier ist viel verstärkte Homophobie mit drin." Die Technikjournalistin Kara Swisher stimmt ebenfalls zu: "All diese reichen Menschen haben die absurdesten Dinge getan, die absurder sind als alles, was ich über Sam gehört habe. Aber weil er ein schwuler Mann in San Francisco ist, wird das als Waffe verwendet."

In den letzten zehn Jahren hatten Führungskräfte von Social-Media-Unternehmen einmal versprochen, sie könnten "die Welt verändern" mit fast keinen Nebenwirkungen und wiesen regulatorische Forderungen als "Luddisten" zurück, was schließlich bipartisanen Unmut auslöste. Im Gegensatz dazu erschien Altman besonders "selbstbewusst." Er scheute sich nicht nur nicht vor Regulierung, sondern forderte sie aktiv. Im Jahr 2023 schlug er bei seiner Aussage vor dem Justizausschuss des US-Senats vor, eine neue Bundesbehörde zur Regulierung fortschrittlicher KI-Modelle einzurichten. "Wenn diese Technologie schiefgeht, werden die Folgen sehr schwerwiegend sein," sagte er. Der Senator von Louisiana, John Kennedy, bekannt für seine scharfen Bemerkungen gegenüber CEOs von Technologieunternehmen, schien sogar etwas zustimmend und schlug halb im Scherz vor, dass Altman selbst die Regulierung übernehmen sollte.

Während er jedoch öffentlich Regulierung begrüßte, lobbyierte Altman auch privat dagegen. Laut Time hat OpenAI zwischen 2022 und 2023 erfolgreich einen Vorschlag zur Regulierung der Europäischen Union, der sich gegen große KI-Unternehmen richtete, abgeschwächt. Im Jahr 2024 führte die kalifornische Legislative ein Gesetz ein, das Sicherheitstests für KI-Modelle vorschrieb, von denen viele Altman’s Advocacy im Kongress eng widerspiegelten. OpenAI sprach sich öffentlich gegen das Gesetz aus und übte im Hintergrund Druck aus. „Im Laufe dieses Jahres haben wir beobachtet, dass sich das Verhalten von OpenAI immer raffinierter und irreführender entwickelte“, sagte uns ein legislative Mitarbeiter.

In der Zwischenzeit setzte Musk seine öffentlichen Angriffe auf Altman fort und bezeichnete ihn als „Betrüger Altman“ und „Schwindler Sam“. (Als Altman sich über ein Problem mit einem Tesla auf X beschwerte, antwortete Musk: „Du hast von einer gemeinnützigen Organisation gestohlen.“) Aber in Washington schien Altman die Oberhand zu haben. Musk hatte einst über 250 Millionen Dollar beigetragen, um Donald Trump zur Wiederwahl zu verhelfen, und war kurzzeitig im Weißen Haus tätig, bevor er ging, was seine Beziehung zu Trump trübte.

Heute ist Altman einer von Trumps bevorzugten Tech-Tycoons geworden und besuchte sogar Windsor Castle im Vereinigten Königreich mit ihm. Die beiden sprechen mehrmals im Jahr miteinander. „Du kannst ihn einfach direkt anrufen“, sagte Altman. „Es ist nicht so eine Art von Freundschaft, aber wenn ich mit ihm über etwas sprechen muss, werde ich anrufen.“ Als Trump letztes Jahr Tech-Führer im Weißen Haus empfing, war Musk abwesend, und Altman saß dem Präsidenten gegenüber. „Sam, du bist ein großer Fisch“, sagte Trump zu ihm. „Du hast mir vorher einige unglaubliche Dinge erzählt.“

Der Investor Ron Conway lobbyierte ebenfalls bei politischen Persönlichkeiten, darunter Nancy Pelosi und Gavin Newsom, um die Ablehnung des genannten Gesetzes zu fördern. Letztendlich, obwohl das Gesetz parteiübergreifende Unterstützung erhielt und verabschiedet wurde, wurde es von Newsom mit einem Veto belegt. In diesem Jahr sahen sich einige Kongresskandidaten, die die Regulierung von KI unterstützen, Gegnern gegenüber, die von „Leading the Future“, einem pro-KI Super-PAC, finanziert wurden. OpenAI erklärte offiziell, dass es nicht an solche Organisationen spenden würde, aber sein Mitbegründer Greg Brockman versprach 50 Millionen Dollar. (Im selben Jahr spendeten er und seine Frau auch 25 Millionen Dollar an ein Super-PAC, das Trump unterstützte.)